- سُمح بالنشر: مقتل الرقيب أول غاي لودر من وحدة مجلان وإصابة آخر بجراح خطيرة في معارك جنوب لبنان

- انطلاق تظاهرات ضد الحرب في عدة مناطق: الشرطة تبدأ بتفريق مظاهرة تل ابيب

- سُمح بالنشر: مقتل جندي اسرائيلي خلال المعارك في جنوب لبنان

- الحرب على إيران.. انقطاع الكهرباء شمال حيفا وترمب يهدد طهران “بالجحيم”

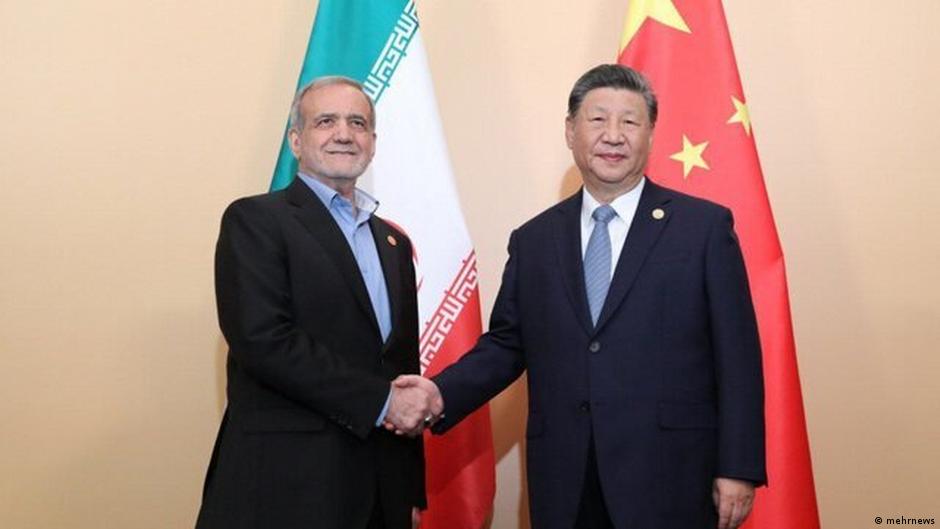

- بكين وحرب إيران.. استراتيجية تأثير أم استعراض دبلوماسي؟

- قذائف متشظية من إيران تضرب غوش دان والقدس وتخلّف أضرارًا في العيسوية والكرياه

- مجددًا: رصد رشقات من ايران تجاه الشمال- دوي انفجارات

- مقتل جندي إسرائيلي على حدود لبنان: الإشتباه انه مخرب

- اتحاد مدن بحيرة طبريا: مفتشو الاتحاد وأفراد الشرطة قاموا بإخلاء المستجمين من الشواطئ

- الجبهة الداخلية تُبقي القيود دون تغيير خلال عطلة عيد الفصح

- سلوت يعلق على خسارة ليفربول برباعية.. "أمر مخيب للغاية"

- أميركا تعلن اعتقال سيدتين.. تربطهما علاقة بقاسم سليماني

- دون خسائر.. الكويت تعترض صواريخ ومسيّرات معادية

- روسيا تستهجن ضرب محطة بوشهر النووية: أعمال غير قانونية ومتهورة

- أمريكا تعتقل سيدتين من أقارب قاسم سليماني

- 6 إعدامات خلال أيام في إيران.. والمعارضة تطلق تحذيرا

- إجلاء عشرات الروس من "بوشهر".. وتحذير من خطر نووي

- ترامب: "الوقت ينفد" أمام إيران لإعادة فتح مضيق هرمز

لتجنب التقاضي.. "مايكروسوفت" تضع Copilot في سلة أدوات الترفيه

رغم كثرة الشكاوى من استبدال الذكاء الاصطناعي للمهارات البشرية، فهناك جانبًا آخر؛ فقد أجبر صعود الذكاء الاصطناعي البشر على تطوير مهارات جديدة، لا سيما القدرة على تمييز مخرجات الذكاء الاصطناعي المفيدة من تلك الخاطئة والمضللة.

خلال العامين الماضيين، أتقن كثيرون هذه المهارة، وتعلموا كيفية الاستفادة القصوى من القيود العديدة التي يواجهونها مع هذا الكم الهائل من أنظمة الذكاء الاصطناعي.

وبينما تدرك الشركات التي تطور هذه الأدوات الذكية هذه القيود، يبدو أن إحداها تُبالغ قليلًا في الجانب القانوني، إذ لاحظ مستخدمو المساعد الذكي " Copilot" التابع لشركة مايكروسوفت بعض العبارات المثيرة للقلق في شروط الخدمة، بحسب تقرير لموقع "Tom's Hardware" المتخصص في أخبار التكنولوجيا، اطلعت عليه "العربية Business".

تُصدر جميع الشركات الكبرى إخلاء مسؤولية بشأن دقة وصحة مخرجات أنظمة الذكاء الاصطناعي التابعة لها، محاولةً الترويج لمزايا منتجاتها مع الإقرار في الوقت نفسه بقيودها.

لكن يبدو أن "مايكروسوفت" مضت إلى ما هو أبعد من مجرد إخلاء المسؤولية المعتاد خاصة بالنظر إلى الخدمة التي تقدمها.

وفي شروط استخدام "Copilot" قالت "مايكروسوفت" إن "Copilot مخصص لأغراض الترفيه فقط". ويُعتبر استخدام "فقط" أمرًا صادمًا بعض الشيء خاصة لعملاء "مايكروسوفت" من الشركات.

وتمضي الشركة قائلة في شروط الاستخدام: "قد يرتكب أخطاء، وقد لا يعمل كما هو مقصود. لا تعتمد على Copilot للحصول على نصائح مهمة. استخدم Copilot على مسؤوليتك الخاصة".

وهذه العبارة تبدو إلى حد كبير متماشية مع التحذيرات التي تكتبها شركات الذكاء الاصطناعي الأخرى، مثل كن حذرًا وتحقق من صحة أي مخرجات للذكاء الاصطناعي قبل اتخاذ أي إجراء.

لكن تحذير "مايكروسوفت" يبدو مثيرًا للسخرية، بالنظر إلى حرص الشركة على استخدام "Copilot" من قِبل الشركات ودمجها له في نظام التشغيل ويندوز 11.

المصدر:

العربيّة

المصدر:

العربيّة