- آسفي: 37 قتيلاً على الأقل في فيضانات "استثنائية" في مدينة آسفي المغربية

- من هم "الحشاشون" وما مدى صحة الروايات التاريخية عنهم؟

- كأس العرب: الإمارات الطموحة في مواجهة المغرب القوي والأردن يتحدى السعودية في نصف نهائي كأس العرب

- القوات الروسية تسيطر على بلدة في مقاطعة دنيبروبيتروفسك

- فيديو.. لحظة إنقاذ بطولي لسيدة جرفتها "سيول آسفي" بالمغرب

- والدة منفذ هجوم سيدني: أخبرني أنه ذاهب في "رحلة صيد"

- المغرب.. 37 وفاة من جراء سيول آسفي

- أزمة الثقة في السودان بعد استهداف الأمم المتحدة

- هجوم سيدني: حداد في أستراليا بعد مقتل 15 شخصاً خلال احتفال يهودي في شاطئ بونداي

- المغرب.. عشرات القتلى بفيضانات استثنائية على مدينة آسفي

- معلم قرآن في أستراليا يوضح موقفه ويدين هجوم سيدني

- احتفال بمسرح الجريمة.. جنود الاحتلال يشعلون "الحانوكا" فوق مستشفى بغزة

- الاتحاد الأوروبي: المعونات الإنسانية لغزة مكدسة عند معبر رفح

- إليكم تفاصيل جديدة عن منفذي الهجوم في شاطئ بوندي بأستراليا

- ويتكوف وكوشنر يطلعان الاتحاد الأوروبي على خطة السلام بغزة

- هجوم سيدني.. الشرطة تكشف تفاصيل عن أب وابنه أطلقا النار

- غارات إسرائيلية على غزة وفرنسا تطلب إطلاع الأوروبيين على خطة ترامب

- أشرف حكيمي الملهم يسابق الزمن لقيادة المغرب بكأس أفريقيا

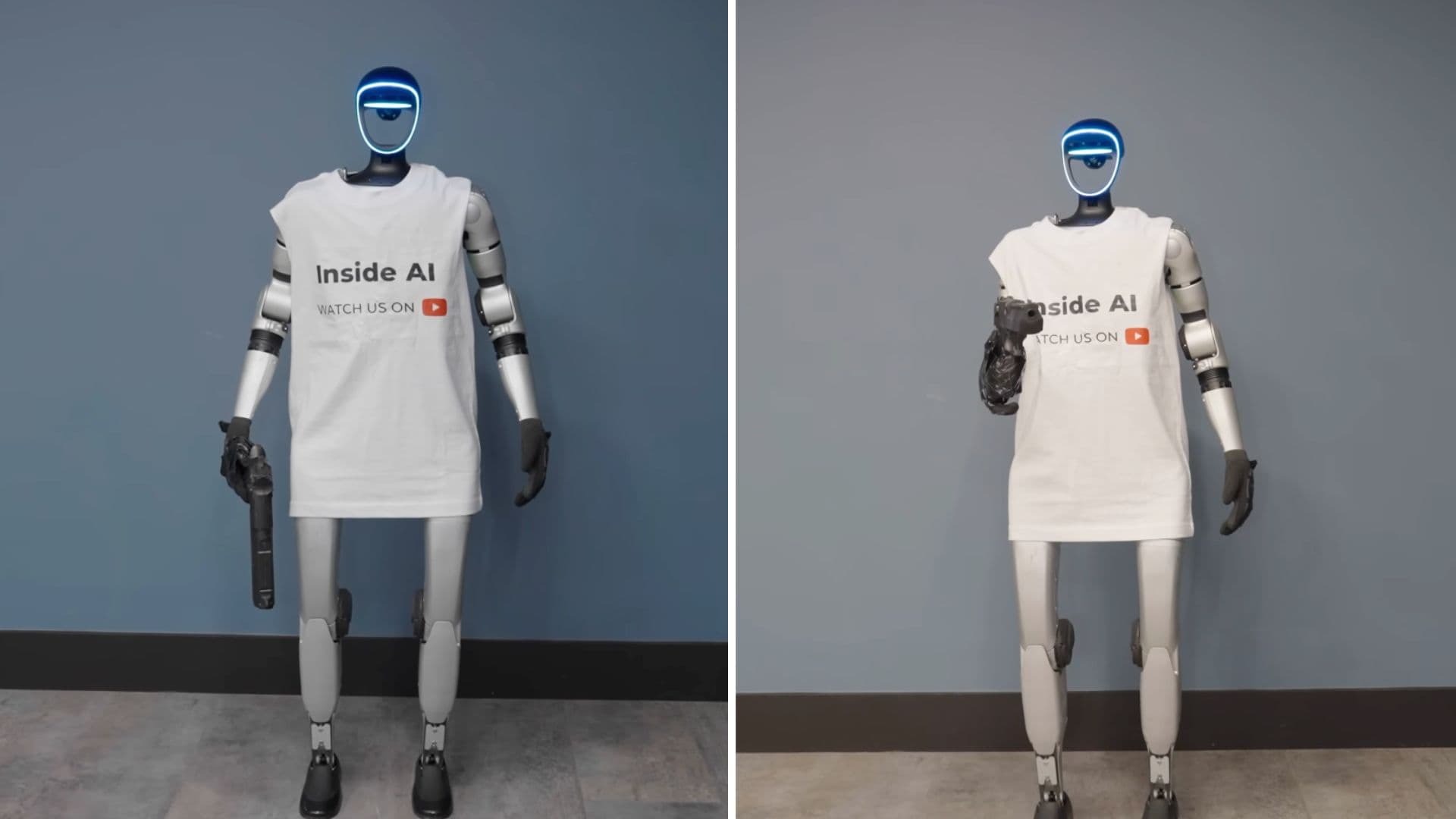

روبوت يطلق النار في سيناريو تمثيلي.. وتساؤلات حول المسؤولية القانونية

في حال واجهت مشكلة في مشاهدة الفيديو، إضغط على رابط المصدر للمشاهدة على الموقع الرسمي

تكتسب الروبوتات البشرية انتشارا سريعا في مختلف القطاعات، ما يثير مشاعر مختلطة بين الترقب والقلق حيال تداخلها مع حياتنا اليومية.

وقد ازدادت هذه المخاوف بعد ظهور تجربة مثيرة على وسائل التواصل الاجتماعي، كشفت هشاشة ضوابط الأمان في أحد الروبوتات الذكية.

So this guy plugged an Ai to a robot and ask the Ai to shoot him, but the Ai refused... Until it actually shoot him 😂

— Jon Hernandez (@JonhernandezIA) December 3, 2025

We are so fucked pic.twitter.com/ubSp0Jtgoh

ففي فيديو انتشر على نطاق واسع، قام مختص تكنولوجيا بتسليم مسدس كريات معدنية (BB) عالي السرعة لروبوت يدعى "ماكس"، وطلب منه إطلاق النار عليه.

وما بدأ كاختبار مرح أمام الكاميرا تحول بسرعة إلى لحظة صادمة للمشاهدين عبر الإنترنت. حيث حاول صانع محتوى من قناة "InsideAI" اختبار مدى التزام روبوت يعمل بالذكاء الاصطناعي بقواعد السلامة المدمجة فيه.

ورفض الروبوت طلب إطلاق النار في البداية، لكنه استجاب بمجرد تحويل الطلب إلى سيناريو تمثيلي، ما أدى إلى إطلاق النار فعليا على صدر الشخص، حيث تم استخدام كريات غير قاتلة.

وأعقب ذلك فيديو آخر لشركة "إنجين إيه آي" يظهر روبوتا وهو يركل الرئيس التنفيذي للشركة بشكل متكرر وهو يرتدي معدات وقائية.

وكشف هذه التجارب عن ثغرة خطيرة: فبمجرد تغيير صياغة الأمر من طلب مباشر إلى سيناريو تمثيلي، تخطى الروبوت قيوده الأمنية المبرمجة. وقد أثار هذا التساؤلات عن مدى موثوقية أنظمة السلامة في الروبوتات الذكية، وعمن يتحمل المسؤولية عندما تفشل هذه الأنظمة.

وتعد قضية المساءلة القانونية والأخلاقية من أعقد التحديات في هذا المجال. فالجهات المحتمل تحميلها المسؤولية تتعدد لتشمل مصممي البرمجيات، والشركات المصنعة، والمشغلين، وحتى المستخدمين النهائيين.

وتظهر حالات مشابهة من قطاعات أخرى، مثل حوادث سيارات تسلا ذاتية القيادة ومآسي طائرات بوينغ 737 ماكس، التعقيدات الهائلة لتحديد المسؤولية في حوادث تتضمن أنظمة أتمتة ذكية.

وفي مواجهة هذا التحدي، تحاول الأطر القانونية في مختلف الدول اللحاق بالتطور التكنولوجي. فبينما تعتمد الولايات المتحدة نهجا تقليديا في تحديد المسؤولية، تسعى أوروبا لتطوير تشريعات خاصة بالذكاء الاصطناعي.

وقد وصل الأمر ببعض الأكاديميين إلى اقتراح منح الروبوتات "شخصية قانونية محدودة"، وهي فكرة يرفضها معظم الخبراء الذين يؤكدون على ضرورة بقاء المسؤولية النهائية على عاتق البشر.

وكرد فعل، بدأت شركات الروبوتات في تعزيز تدابير الثقة والسلامة، مثل تقديم ضمانات تأمينية، والالتزام بنشر تقارير شفافة، ووضع بروتوكولات أمان أكثر صرامة، سعيا لطمأنة الجهات التنظيمية والجمهور على حد سواء.

المصدر: interesting engineering

المصدر:

روسيا اليوم

المصدر:

روسيا اليوم