- حرب إيران.. احتدام القصف المتبادل وطهران ترفض وقفا مؤقتا لإطلاق النار

- 170 طائرة.. ترامب يكشف تفاصيل عملية إنقاذ الطيارين

- "سرق" دوناروما.. فتى 14 عاماً يتسبب في حرمان إيطاليا من كأس العالم

- ثالث رسالة مكتوبة من مجتبى خامنئي دون ظهوره

- ترامب: يمكن هزيمة إيران في "ليلة واحدة" قد تكون غدًا

- إسرائيل تضرب طائرات ومروحيات إيرانية في مطارات طهران

- ترامب: مقترح وقف إطلاق النار "ليس جيدا بما يكفي لكن مهم"

- إيران ترد على مقترح أمريكا.. الإعمار ورفع العقوبات وبروتوكول لهرمز

- هجوم متزامن من إيران ولبنان واليمن يستهدف تل أبيب والقدس وإيلات

- قصف إسرائيلي يوقع 10 شهداء رغم وقف إطلاق النار في غزة

- البرهان يلغي مناصب بالجيش ويُعيد تشكيل رئاسة الأركان

- إصابات نتيجة اعتراضات لصواريخ إيرانية في دول الخليج والأردن والعراق

- كيف ساعدت حضارات العراق ومصر القديمة في تشكيل طريقة قياسنا للوقت؟

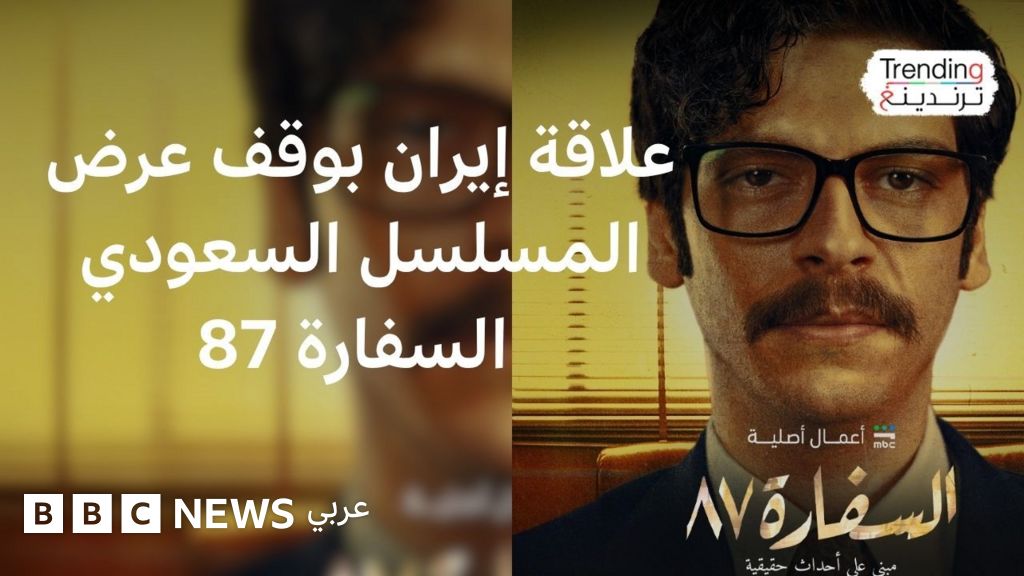

- السفارة 87: هل دفعت الحرب مجموعة #MBC لتأجيل عرض مسلسل يروي أحداث احتجاز دبلوماسيين سعوديين في طهران؟

- "يا مجانين" و "يا أولاد …" بكلمات نابية ترامب يهدد إيران لفتح مضيق هرمز

- القاتل "غوثام".. الذكاء الاصطناعي الذي يقود الحرب على إيران

- كاتبة: يتأكد فقط أنه فلسطيني ثم يعدمه بذريعة أنه يشكل خطرا

- ترامب: الثلاثاء هو الموعد النهائي لإيران

القاتل "غوثام".. الذكاء الاصطناعي الذي يقود الحرب على إيران

في حال واجهت مشكلة في مشاهدة الفيديو، إضغط على رابط المصدر للمشاهدة على الموقع الرسمي

"آلة الذكاء الاصطناعي تقدم توصيات بشأن ما يجب استهدافه بسرعة تفوق سرعة التفكير البشري"

بواسطة كريغ جونز - جامعة نيوكاسل

في صباح يوم 28 من فبراير/شباط الماضي، بينما كانت عشرات الفتيات يدخلن مدرسة الشجرة الطيبة الابتدائية في مدينة ميناب جنوب إيران، كانت أنظمة الاستهداف الأمريكية والإسرائيلية قد أنجزت مهمتها فعلا بتحديد أهداف القصف. لكن لم تعرف تلك الطالبات أنهن قد صرن هدفا ضمن قائمة أهداف ربما أعدها نموذج ذكاء اصطناعي وصادق عليها مسؤول بشري.

خلال الـ12 ساعة الأولى من عملية "الغضب الملحمي"، نفذت القوات الجوية الأمريكية ما يقرب من 900 ضربة على أهداف إيرانية عبر 17 محافظة، وقد اغتالت تلك الضربات المرشد الأعلى علي خامنئي، ودمرت مواقع صاروخية ومنظومات دفاع جوي ومراكز قيادة وسيطرة، ودمرت مدرسة ابتدائية للفتيات، كل ذلك في آن واحد، لكن كيف حدث استهداف القيادة السياسية والبنية الصاروخية والدفاعات الجوية ومنظومات التحكم والسيطرة، بهذه الكثافة وفي الوقت ذاته؟ ما الذي تغير في المعادلة الحالية مقارنة بالحروب السابقة؟

اقرأ أيضا

list of 2 items* list 1 of 2 حرب المخازن.. لماذا لم تنفد صواريخ إيران حتى الآن؟

* list 2 of 2 المعرفة المحرمة.. "الاحتكار" الذي يفسر حرب أمريكا وإسرائيل على إيران end of list

كان نموذج "كلود" (Claude)، من شركة "أنثروبيك" (Anthropic)، أول نظام ذكاء اصطناعي متقدم يعمل داخل الشبكات العسكرية الأمريكية المصنفة سريا، عبر شراكة مع شركة بالانتير (Palantir) المتخصصة في تحليل البيانات الدفاعية، وبموجب عقد بقيمة 200 مليون دولار وقع في يوليو/تموز 2025، عمل النظام على معالجة كميات هائلة من البيانات الاستخباراتية، وتحليل سيناريوهات الاستهداف، وتقييم الأسس القانونية للضربات.

وقد وصف كريغ جونز، المحاضر في الجغرافيا السياسية بجامعة نيوكاسل والمتخصص في سلاسل القتل، ما يحدث في حديث لصحيفة الغارديان قائلا: "آلة الذكاء الاصطناعي تقدم توصيات بشأن ما يجب استهدافه بسرعة تفوق في بعض الأحيان سرعة التفكير البشري"، وأضاف: "لديك النطاق ولديك السرعة. تنفذ ضربات اغتيال في الوقت ذاته الذي تجرد فيه النظام من قدرته على الرد. كان الأمر يستغرق أياما أو أسابيع في الحروب السابقة. الآن تفعل كل شيء دفعة واحدة" .

لكن السرعة وحدها ليست القصة المحورية هنا؛ ففي الحرب الجارية، يسرع الذكاء الاصطناعي خطوات سلسلة القتل عبر تحديد قائمة الأهداف، ويضغط زمن دورة اتخاذ القرار، ويقلص الفجوة بين مرحلة الرصد والضربة. لكننا قد نغفل السؤال الأهم: ماذا يحدث للرقابة البشرية حين تعمل بسرعة الآلة؟ أو بصياغة أخرى: هل هناك أصلا رقابة بشرية على هذا الأمر، أم أن هذا لن يحدث فارقا من الأساس؟ سنحاول تفكيك تلك الأسئلة، في محاولة بسيطة لفهم ما يحدث هنا للمرة الأولى تاريخيا أمام أعين العالم!

مصدر الصورة

مصدر الصورة

حرب الـ12 ساعة

في أول 12 ساعة من الحرب على إيران، نفذت القوات الجوية الأمريكية وحدها نحو 900 ضربة، بينما نفذ سلاح الجو الإسرائيلي أكبر عملية جوية في تاريخه: 200 مقاتلة ضربت نحو 500 هدف في اليوم الأول، مركزة على منصات الصواريخ الباليستية ومواقع الدفاع الجوي وعقد القيادة والسيطرة والمنشآت ذات الصلة بالبرنامج النووي، وتجاوز العدد الإجمالي ألف هدف في أول 24 ساعة، وبلغ 1250 هدفا خلال 48 ساعة. بحلول الساعة المئة، أعلن الأدميرال براد كوبر، قائد القيادة المركزية، أن العملية ضربت نحو 2000 هدف بأكثر من 2000 وحدة ذخيرة موجهة.

"خلال 100 ساعة، ضربت أمريكا وإسرائيل نحو 2000 هدف إيراني، يفترض أن يخضع كل منها لدورة كاملة من التحديد والتقييم والموافقة والتنفيذ فيما يعرف بسلسلة القتل"

لاحظ هنا أن هذه ليست أرقاما عن طلعات جوية، وهو المقياس الذي استخدمته الحروب الأمريكية السابقة. الطلعة الجوية هي رحلة طائرة واحدة، قد تضرب هدفا واحدا أو لا تضرب شيئا، لكن ما نتحدث عنه هنا هو أهداف مستقلة، كل منها خضع لدورة كاملة من التحديد والتقييم والموافقة القانونية واختيار السلاح والتنفيذ فيما يعرف بمفهوم "سلسلة القتل" (Kill Chain). وهو مفهوم يوضح المسار الذي تسلكه أي عملية عسكرية من لحظة اكتشاف الهدف حتى تعطيله أو تدميره.

وتتكون السلسلة من ست خطوات مترابطة، كل واحدة تغذي التي تليها. الأولى الرصد، أي أن ترى أن هناك هدفا. ثم التحديد والتصنيف، أي أن تعرف ما هو وما قيمته، ثم تثبيت موقعه وتتبعه، ثم اتخاذ القرار وتخصيص السلاح المناسب، ثم الاشتباك أو إحداث التأثير المطلوب. وأخيرا التقييم، أي التأكد من تحقق الأثر أو الحاجة إلى تكرار الضربة.

مثلا في حرب الخليج 1991، احتاج سلاح الجو الأمريكي إلى أشهر من التخطيط لإنتاج قائمة أهداف مكونة من بضع مئات، واحتاج قصفها لأسابيع طويلة، بينما في الحرب على إيران، ظهرت قوائم أهداف بالآلاف ونفذ القصف خلال أيام معدودة.

في الحروب التقليدية، كانت الحلقة الأبطأ في سلسلة الاستهداف هي التحليل البشري: ضابط استخبارات يدرس صور الأقمار الاصطناعية، ومحلل يربط بيانات الإشارات، ومستشار قانوني يراجع تقدير الأضرار المدنية المتوقعة، وكل خطوة تستغرق وقتا، وكل قرار يستنزف طاقة معرفية. هذا القيد لم يكن خللا في المنظومة، بل كان صمام أمان، فالسعة المعرفية للإنسان كانت تفرض حدا طبيعيا على عدد الأهداف التي يمكن معالجتها في وحدة زمنية بعينها.

"السعة المعرفية للإنسان عملت صمام أمان يفرض حدا طبيعيا على عدد الأهداف التي يمكن معالجتها في فترة زمنية بعينها"

الذكاء الاصطناعي أزال هذا الحد؛ منصة شركة بالانتير للذكاء الاصطناعي تستطيع معالجة تدفقات استخباراتية متعددة في وقت واحد، من صور أقمار اصطناعية واعتراضات إشارات إلى بيانات رادارية ومعلومات مصادر بشرية، ومن ثم تستطيع تحديد الأهداف وترتيبها حسب الأولوية، والتوصية بالسلاح المناسب وفقا للمخزون المتاح والأداء السابق ضد أهداف مشابهة، وتقدم أيضًا تقدير أولي للأضرار الجانبية. الضغط الحقيقي الذي يفرضه الذكاء الاصطناعي لا يتعلق بإنتاج تلك الأهداف، بل في سرعة تحويلها من قوائم أهداف مقترحة إلى حطام فعلي على أرض المعركة.

وهنا تتبلور الصورة أكثر، القيادة المركزية الأمريكية وصفت العملية بأنها "أكثر حملة جوية فتكا وتعقيدا ودقة في التاريخ". كلمة "الدقة" هنا تستحق التأمل؛ في الحروب السابقة، كانت الدقة تعني إصابة الهدف المقصود بدلا من القصف العشوائي، لكن في إيران، أصبحت تعني شيئا مختلفا: القدرة على معالجة آلاف الأهداف إداريا وقانونيا وتشغيليا في وقت لم يكن يكفي سابقا لمعالجة عشرات منها، والدقة لم تعد صفة للسلاح ذاته، بل أصبحت صفة للبيروقراطية، والذكاء الاصطناعي هو الذي أنتج تلك البيروقراطية السريعة، في محاولة لتسريع سلسلة القتل.

لكن كيف تعمل هذه البيروقراطية فعلا من الداخل، وما الذي يراه الضابط على شاشته حين يطلب منه "مراجعة" هدف أنتجته الآلة؟

مصدر الصورة

مصدر الصورة

داخل سلسلة القتل

تخيل أنك ضابط استهداف في غرفة عمليات مشتركة؛ أمامك شاشة متصلة بمنظومة "مافن" (Maven) التي طورتها شركة بالانتير، وفي قلبها نموذج الذكاء الاصطناعي كلود من شركة "أنثروبيك". لا تحتاج إلى البحث في ملفات استخباراتية أو مقارنة صور أقمار اصطناعية يدويا. تكتب سؤالا عاديا: ما الوحدات المعادية في هذا القطاع؟

المنظومة تجيب خلال ثوان، مستخلصة بياناتها من تدفقات استخباراتية متعددة في الوقت الحقيقي، مثل صور أقمار اصطناعية، واعتراضات إشارات، ومراقبة جوية بطائرات مسيرة، وتقارير مصادر بشرية. ثم تقترح خيارات متعددة للتعامل مع كل هدف، ترسل بعدها إلى القائد لاختيار مسار العمل.

تعرف هذه البنية باسم منصة "بالانتير غوثام" (Gotham)، وهي منصة شركة بالانتير الدفاعية الأساسية، وهي تدمج قواعد بيانات متعددة في واجهة واحدة: استخبارات جغرافية مكانية، وتحليلات شبكات، وتنبيهات فورية، وتوقعات تنبؤية، وفوق هذه المنصة، تعمل طبقة الذكاء الاصطناعي (ِAIP) التي أطلقتها الشركة عام 2023، وهي تدمج نماذج اللغة الضخمة مثل نموذج "كلود" في بيئات عسكرية مصنفة سريا.

يتفاعل المشغل العسكري مع النظام بلغة طبيعية: يسأل أسئلة، ويطلب صورا عالية الدقة، ويستعرض ملخصات لخطط عمليات، والنظام لا يكتفي بتحليل البيانات، بل ينتج مسارات عمل متعددة لتحييد أهداف محددة، يرسلها إلى القائد لتقييمها واختيار إحداها.

في إيران، كان نموذج "كلود" محوريا في عمل منظومة "مافن" الذكية، استنادا إلى ما نشرته واشنطن بوست والغارديان، إذ اقترحت المنظومة مئات الأهداف مع إحداثيات دقيقة، ورتبتها حسب الأولوية. المنظومة أيضا أوصت بأسلحة محددة لكل هدف، واستخدمت "الاستدلال الآلي" لتقييم الأسس القانونية لكل ضربة. بمعنى أبسط: الآلة لم تحلل البيانات فحسب، بل أنتجت خطة عمل شبه متكاملة، لتمنح الإنسان فرصة الاختيار من قائمة أهداف، بدلا من أن يبني تلك القائمة بنفسه.

لكن دور نموذج "كلود" تجاوز تحليل الاستخبارات واقتراح الأهداف؛ وتشير التقارير إلى أن القيادة المركزية استخدمت النموذج في "التخطيط المحاكي للمعارك ونمذجة السيناريوهات"، بمعنى محاكاة ردود الفعل الإيرانية المحتملة، وحساب احتمالات الاعتراض، وتحسين توزيع القوات الأمريكية.

"الذكاء الاصطناعي يضغط سلسلة القتل بأكملها، من لحظة تحديد الهدف إلى لحظة تدميره، من أيام أو حتى أسابيع إلى ساعات"

كريغ جونز، المحاضر بجامعة نيوكاسل، وفي حديث مفصل مع مجلة فورتشن، أكد أن الذكاء الاصطناعي ضغط "سلسلة القتل" بأكملها، من لحظة تحديد الهدف إلى لحظة تدميره، من أيام أو أسابيع إلى ساعات، وذهب إلى أبعد من ذلك قائلا إن الضربات الأمريكية الإسرائيلية على إيران، بما فيها اغتيال خامنئي، "ربما لم تكن لتحدث لولا الذكاء الاصطناعي" .

وهنا تبرز المفارقة الأكثر وضوحا، فقبل ساعات من بدء القصف، أعلن ترمب حظر تقنية أنثروبيك في جميع الوكالات الفيدرالية، لكن نموذج "كلود" استخدم في الضربات الأولى على إيران رغم ذلك، لأن الجيش لم يجد بديلا قادرا على استلام المهمة فورا. مسؤولون في البنتاغون وصفوا فك ارتباط "كلود" من المنظومة بأنه سيكون "مزعجا جدا"، واستنادا إلى واشنطن بوست، حتى لو طالب داريو أمودي، الرئيس التنفيذي لـ"أنثروبيك"، الجيش بالتوقف عن استخدام النموذج، كانت الإدارة الأمريكية ستستخدم صلاحيات حكومية للاحتفاظ بالتكنولوجيا إلى حين إيجاد بديل جاهز، فالمنظومة التي حظرت سياسيا هي ذاتها التي لا يمكن الاستغناء عنها عمليا.

ديفيد ليزلي، أستاذ أخلاقيات التكنولوجيا في جامعة كوين ماري بلندن، يصف ما يحدث داخل غرف العمليات بمصطلح أدق من السرعة وهو "التفريغ المعرفي" (cognitive offloading)، حين يشعر الإنسان المكلف بقرار الضربة بالانفصال عن عواقبها، لأن جهد التفكير فيها أنجزته الآلة فعلا، وأضاف ليزلي لصحيفة الغارديان: "هذه المنظومات تنتج مجموعة خيارات لصانع القرار البشري، لكن النطاق الزمني المتاح لتقييم التوصية أضيق بكثير" .

يطلق الأكاديميون على هذا "ضغط القرار"، أي حين يضغط الذكاء الاصطناعي الزمن المطلوب للتخطيط من أيام إلى دقائق، فيتحول الخبراء العسكريون والقانونيون من مناقشين أو محللين إلى مجرد مصادقين على خطط عسكرية أنتجتها الآلة.

"يصنع الذكاء الاصطناعي حالة من التفريغ المعرفي، حين يشعر الإنسان المكلف بقرار الضربة بالانفصال عن عواقبها، لأن جهد التفكير فيها أنجزته الآلة فعلا"

اللافت للنظر أن شركة بالانتير ليست حاضرة في الجانب الأمريكي فحسب؛ ففي يناير/كانون الثاني 2024، أعلنت الشركة عن "شراكة إستراتيجية" مع جيش الاحتلال الإسرائيلي لـ"مهام مرتبطة بالحرب". وقد وصف أحد مسؤوليها التنفيذيين تقنيتها بأنها وسيلة لـ "تحسين سلسلة القتل". وعلى موقع الشركة الرسمي، يوصف عرض "غوثام" للاستهداف بأنه يدعم الجنود "بسلسلة قتل مدعومة بالذكاء الاصطناعي، تدمج بسلاسة ومسؤولية تحديد الأهداف وربطها بالسلاح المناسب"، فالشركة ذاتها التي بنت منظومة الاستهداف الأمريكية في إيران هي التي تعمل مع الجيش الإسرائيلي في قطاع غزة. التكنولوجيا تتنقل بين الحروب، والبنية التحتية واحدة.

لذا لدينا الآن على الورق منظومة تحلل البيانات بكفاءة، وتقترح خيارات استهداف، والإنسان يقرر، لكن ماذا يحدث حين تنتج المنظومة 900 هدف في 12 ساعة وتطلب من الإنسان "مراجعتها"؟ هل يراجع حقا، أم يصادق على اختيارات الآلة دون مراجعة؟ الفارق بين الفعلين هو المسافة بين الرقابة الحقيقية والمسرحية القانونية.

مصدر الصورة

مصدر الصورة

التجربة كانت في غزة

لنحسبها معا الآن، 900 ضربة في 12 ساعة تعني 75 ضربة في الساعة، أو ضربة وربع كل دقيقة. كل ضربة تتطلب -نظريا- مراجعة بشرية تشمل التحقق من هوية الهدف، وتقدير الأضرار المدنية المتوقعة، وتقييم التناسب بين الميزة العسكرية والضرر الجانبي، والموافقة القانونية. لا نعرف عدد الأشخاص الذين شاركوا في مراجعة هذه الأهداف في إيران، ولا الوقت الذي أتيح لكل منهم، لكننا نملك بعض المعرفة السابقة.

في الحرب على قطاع غزة، كشف ستة ضباط استخبارات إسرائيليين لمجلة "+972" أن وقت المراجعة البشرية لكل هدف أنتجه نظام "لافندر"، وهو منصة الذكاء الاصطناعي العسكري التي استخدمتها إسرائيل، كان 20 ثانية فقط. عشرون ثانية للتحقق من أن الهدف ثم الموافقة، لم يكن مطلوبا من الضباط "فحص السبب الذي جعل الآلة تختار هذا الشخص أو الهدف، أو مراجعة البيانات الاستخباراتية الخام التي استندت إليها".

"في الحرب على قطاع غزة، كان وقت المراجعة البشرية لكل هدف أنتجه نظام لافندر، وهو منصة الذكاء الاصطناعي العسكري التي استخدمتها إسرائيل، يقدر بـ 20 ثانية فقط"

ما حدث في غزة له اسم في الأبحاث الأكاديمية وهو "التحيز التلقائي"، الذي تعرفه اللجنة الدولية للصليب الأحمر بأنه "ميل البشر إلى الاعتماد المفرط على الأنظمة المؤتمتة والانقياد لمخرجات تلك التقنيات". الأدلة على هذه الظاهرة واسعة في مجالات الطيران المدني والرعاية الصحية والقضاء، وفي السياق العسكري، تتفاقم المشكلة تحت ضغط الوقت، فحين يكون الوقت المتاح لتقييم مخرجات الذكاء الاصطناعي محدودا، يميل صانعو القرار إلى القبول بتوصيات النظام حتى في وجود أدلة مناقضة.

وفي دراسة نشرت في مجلة "الشؤون الدولية" الصادرة عن جامعة أكسفورد، فُحصت تحديدا حالة أنظمة "غوسبل" و"لافندر" الإسرائيلية في غزة، وخلصت إلى أن "مخرجات الذكاء الاصطناعي لم تعامل كتوصيات، بل كموافقات ضمنية، ممنوحة سلطة اتخاذ قرار أشبه بأمر القائد دون مساءلة أخلاقية". بمعنى آخر: النظام لم يقترح فحسب، بل تحول ليصبح صاحب القرار نفسه، والإنسان أصبح الواجهة التي يمر عبرها القرار إلى التنفيذ.

لورين كان، الباحثة في مركز الأمن والتكنولوجيا الناشئة بجامعة جورج تاون، صاغت هذه المعضلة في تحليل نشره مركز بيري وورلد هاوس بجامعة بنسلفانيا بعنوان: "أسطورة الإنسان في الحلقة وواقع التفريغ المعرفي". الأطروحة المركزية كانت هي أن الأنظمة ذاتها التي تقلل العبء المعرفي وتعزز القدرة البشرية "تخاطر أيضا بتشجيع الاعتماد المفرط والتفريغ غير الملائم للحكم إلى الآلات".

المخاطر الحقيقية لهذا النهج لا تكمن في التكنولوجيا ذاتها، بل في "الاحتكاكات الناجمة عن التفاعل بين البشر والآلات". صانعو السياسات والجيوش "يجب أن يتجاوزوا الراحة الزائفة لمقولة الإنسان في الحلقة"، أي ذلك الافتراض المطمئن بأن وجود إنسان ضمن عملية اتخاذ القرار يكفي لضمان السيطرة والرقابة، بينما الواقع قد يكشف أن هذا الإنسان يتحول تدريجيا إلى مراقب صامت، يصدق على قرارات الآلة أكثر مما يراجعها.

"في الحروب السابقة، كانت الدقة سمة السلاح: صاروخ موجه يصيب مبنى بدلا من حي كامل. في إيران، أصبحت الدقة سمة البيروقراطية: القدرة على إنتاج ملف متكامل لكل هدف"

وهنا يتبلور المعنى الجديد لكلمة "الدقة" التي تتكرر في بيانات البنتاغون والجيش الإسرائيلي. في الحروب السابقة، كانت الدقة سمة السلاح: صاروخ موجه يصيب مبنى بدلا من حي كامل. في إيران، أصبحت الدقة سمة البيروقراطية: القدرة على إنتاج ملف استهداف متكامل لكل هدف، يتضمن إحداثيات وسلاحا موصى به وتقدير أضرار جانبية وتقييما قانونيا، وكل ذلك بسرعة تجعل المراجعة البشرية الحقيقية مستحيلة. كل ضربة تحمل ختم "مراجَع"، لكن 75 ضربة في الساعة لا تسمح بمراجعة حقيقية، هذا إن توافرت نية المراجعة من الأساس.

منظمة هيومان رايتس ووتش صاغت الأمر في تقريرها الصادر عام 2025 بالقول إنه "لاحترام الحياة البشرية، يجب أن يبقى انتزاعها شأنا بشريا". ولكن حين يتحول قرار القتل إلى نتيجة حتمية لبرمجة مسبقة بدلا من قرار أخلاقي متعمد، يعامل المستهدف كنقطة بيانات وليس ككائن بشري، وقد أضافت اللجنة الدولية للصليب الأحمر تحذيرا أشد: "استخدام منظومات دعم القرار بالذكاء الاصطناعي لتحديد قرارات الاستهداف قد يؤثر على حيوات أكثر بكثير من الأسلحة المستقلة ذاتها". السبب بسيط، وهو أن الأسلحة المستقلة تقتل هدفا واحدا بلا تدخل من الإنسان، لكن منظومة دعم القرار تنتج آلاف الأهداف التي يصادق عليها الإنسان بلا نقاش.

لكن القصة لا تكتمل بالتكنولوجيا وحدها، ففي الأسابيع التي سبقت الضربات على إيران، دار صراع آخر، ليس في ساحة المعركة، بل في مكاتب الحكومة في واشنطن ومقر شركة "أنثروبيك" (Anthropic) في سان فرانسيسكو، طرح سؤالا مهما: من يملك حق الاعتراض على ما تفعله المنظومة الذكية؟ هل هي الشركة التي بنت النموذج؟ أم الحكومة التي تستخدمه؟

الباب الدوار

في مذكرة داخلية سربت إلى الصحافة، وصف داريو أمودي، الرئيس التنفيذي لشركة "أنثروبيك"، صفقة منافسته "أوبن إيه آي" (OpenAI) مع البنتاغون بأنها "مسرحية سلامة"، في إشارة إلى إجراءات تبدو وكأنها توفر ضمانات للشركة، لكنها قد لا تقيد استخدام نماذجها فعليا. ثم اعتذر أمودي عن المذكرة، قائلا إنها كتبت في "يوم صعب على الشركة" ولا تعكس "آراءه المدروسة". إلا أن هذا الوصف ينسجم مع جوهر الخلاف الذي ظهر لاحقا بين "أنثروبيك" والبنتاغون، إذ دار الجدل تحديدا حول ما إذا كانت القيود الأخلاقية التي تضعها الشركات ستكون ملزمة في الاستخدام العسكري أم قابلة للتجاوز.

"في مكاتب الحكومة في واشنطن ومقر شركة أنثروبيك في سان فرانسيسكو، طُرح سؤال مهم: من يملك حق الاعتراض على ما تفعله المنظومة الذكية؟ هل هي الشركة التي بنت النموذج؟ أم الحكومة التي تستخدمه؟"

التسلسل الزمني يكشف السرعة التي انهارت بها تلك العلاقة بين البنتاغون و"أنثروبيك"؛ في عام 2024، نشرت "أنثروبيك" نموذج كلود على الشبكات العسكرية المصنفة سريا عبر شركة بالانتير، فأصبح أول نموذج ذكاء اصطناعي متقدم يعمل في هذه البيئة. في يوليو/تموز 2025، وقعت الشركة عقدا بقيمة 200 مليون دولار. وفي يناير/كانون الثاني الماضي، استخدم نموذج "كلود" في عملية اعتقال الرئيس الفنزويلي نيكولاس مادورو عبر شراكة بالانتير.

مسؤول في أنثروبيك تواصل مع بالانتير للسؤال عما إذا كان "كلود" قد استخدم في تلك العملية. بالانتير أبلغت البنتاغون، والبنتاغون فسر السؤال على أنه إشارة إلى أن "أنثروبيك" قد تعترض على استخدام تقنيتها في العمليات القتالية، ومن تلك اللحظة، بدأت المشاكل بين الشركة والإدارة الأمريكية.

في التاسع من يناير/كانون الثاني الماضي، أصدر وزير الحرب الأمريكي بيت هيغسيث مذكرة تعلن التوجه نحو "قوة قتالية بالذكاء الاصطناعي"، مع استخدام النماذج "لجميع الأغراض المشروعة، بلا قيود من سياسات الاستخدام" التي تفرضها الشركات. وخلال فبراير/شباط الماضي، طالب البنتاغون شركة "أنثروبيك" بتوقيع عقد يتيح استخدام نموذج "كلود" "لجميع الأغراض المشروعة" دون استثناءات، وقد أصرت شركة "أنثروبيك" على استثنائيين: عدم استخدام النموذج في المراقبة الجماعية المحلية للأمريكيين، وعدم استخدامه في أنظمة قتالية تعمل ذاتيا بالكامل دون إنسان يشارك في سلسلة اتخاذ القرار.

في 24 فبراير/شباط الماضي، قدم هيغسيث إنذارا نهائيا لداريو أمودي في اجتماع متوتر في البنتاغون، وقد عرضت الحكومة بعض التنازلات، لكن "أنثروبيك" قالت إن الصياغة الجديدة "لم تحقق أي تقدم فعلي في منع استخدام كلود في المراقبة الجماعية للأمريكيين أو الأسلحة المستقلة بالكامل"، وإن "الصياغة التي قدمت كتسوية كانت مقترنة بلغة قانونية تسمح بتجاوز تلك الضمانات حسب الرغبة". العرض الأفضل والنهائي من البنتاغون، وفق تقارير أكسيوس، كان سيسمح بجمع بيانات المواطنين الأمريكيين بما في ذلك الموقع الجغرافي وسجل تصفح الإنترنت والمعلومات المالية الشخصية للمشتريات من وسطاء البيانات. ليرد أمودي: "لا نستطيع بضمير مرتاح الإذعان لطلبهم".

ما تلا ذلك جاء في تتابع سريع؛ في 27 فبراير/شباط، أصدر الرئيس الأمريكي ترمب أمرا لجميع الوكالات الفيدرالية بوقف استخدام تقنية "أنثروبيك" فورا مع فترة انتقالية تمتد إلى 6 أشهر. كتب على منصته "تروث سوشيال" أنه "طرد" أنثروبيك. وأعلن هيغسيث تصنيف أنثروبيك "خطرا على سلسلة الإمداد القومي"، وهو تصنيف يستخدم عادة لشركات من دول معادية كهواوي الصينية، وأضاف: "لا يجوز لأي مقاول أو مورد أو شريك يتعامل مع الجيش الأمريكي القيام بأي نشاط تجاري مع شركة أنثروبيك".

" أصدر الرئيس الأمريكي ترمب أمرا لجميع الوكالات الفيدرالية بوقف استخدام تقنية أنثروبيك"

وخلال ساعات من حظر "أنثروبيك"، أعلن سام ألتمان الرئيس التنفيذي لأوبن إيه آي صفقة مع البنتاغون لنشر نماذجها على الشبكات المصنفة بالسرية. قال إن البنتاغون أظهر "احتراما عميقا للسلامة"، لكنه اعترف لاحقا بأن الصفقة كانت متسرعة وأن "المظهر لا يبدو جيدا". أوبن إيه آي نشرت جزءا من عقدها، مدعية عدة خطوط حمراء أهمها: لا مراقبة جماعية محلية، ولا أسلحة مستقلة. لكن العقد يتضمن أيضا عبارة "لجميع الأغراض المشروعة"، وهي العبارة ذاتها التي رفضتها شركة "أنثروبيك".

على الجهة المقابلة، شركة "إكس إيه آي" (xAI) التابعة لإيلون ماسك لم تتردد، ووقعت صفقة مع البنتاغون لنشر نموذج "غروك" (Grok) على الأنظمة المصنفة بالسرية، موافقة على معيار "جميع الأغراض المشروعة" دون قيود. لكن غروك (Grok) "لا يعتبر متقدما أو موثوقا بقدر نموذج أنثروبيك" استنادا إلى نيويورك تايمز.

في الخامس من مارس/آذار، بينما كانت الضربات على إيران على عتبة أسبوعها الأول، تلقت "أنثروبيك" رسالة رسمية من البنتاغون تؤكد تصنيفها "خطرا على سلسلة الإمداد" بأثر فوري، وهو توصيف قانوني في التشريعات الأمريكية يطلق على الأنظمة التي قد تكون عرضة لإساءة الاستخدام أو العبث بها من أحد الخصوم، بما يتيح إدخال وظائف خفية أو التأثير على أدائها، وعمليا، فإن هذا التصنيف يعني حظر استخدام منتجات الشركة، بما في ذلك نموذج "كلود"، على موظفي البنتاغون أو المتعاقدين معه في أي أعمال أو عقود مرتبطة بالمجال العسكري.

رد داريو أمودي قائلا: "لا نعتقد أن هذا الإجراء سليم قانونيا، ولا نرى خيارا سوى الطعن فيه أمام المحاكم". لكنه أضاف أن "أنثروبيك" ستستمر في تقديم خدماتها للجيش "بتكلفة رمزية" طوال فترة الانتقال، "لأن أولويتنا الأهم الآن هي ضمان عدم حرمان مقاتلينا وخبراء أمننا القومي من أدوات مهمة في خضم عمليات قتالية كبرى".

وقع مئات العاملين في شركات التقنية، ومنهم موظفون في أوبن إيه آي وآي بي إم (IBM)، رسالة مفتوحة تطالب البنتاغون بسحب التصنيف والكونغرس بالتحقيق. الرسالة حذرت من أن "معاقبة شركة أمريكية لرفضها قبول تعديلات على عقد ترسل رسالة واضحة لكل شركة تقنية في أمريكا: اقبل أي شروط تفرضها الحكومة، أو واجه الانتقام".

"الموقف الأخلاقي لأي شركة بعينها، مهما كان صادقا، لا يستطيع تقييد تلك المنظومة الفتاكة"

لكن هذا النقاش، على أهميته السياسية والقانونية، يحجب الاستنتاج الأهم، وهو أن الحرب على إيران بدأت بعد ساعات من طرد أنثروبيك، ونموذج كلود استخدم في الضربات الأولى فعلا رغم الحظر. "أوبن إيه آي" دخلت خلال ساعات، ونموذج "غروك" كان جاهزا أصلا. المنظومة لم تتوقف، ولم تتباطأ، ولم تتأثر. هذا يعني أن الموقف الأخلاقي لأي شركة بعينها، مهما كان صادقا، لا يستطيع تقييد تلك المنظومة الفتاكة، وحين رفضت "أنثروبيك" شروط البنتاغون، لم تتوقف آلة الحرب، بل وجدت وقودا لها في شركات أخرى.

إميل مايكل، كبير مسؤولي التكنولوجيا في البنتاغون، صاغ فلسفة الإدارة بوضوح: "في مرحلة ما، عليك أن تثق بجيشك ليفعل الصواب". هذه الثقة هي التي يراهن عليها البنتاغون. "أنثروبيك" رأت أن الثقة لا تكفي حين لا يوجد قانون يحدد ما هو "الصواب" في سياق الذكاء الاصطناعي العسكري. "أوبن إيه آي" من جانبها، رأت أن الأفضل أن تكون داخل المنظومة بحماية ناقصة من أن تكون خارجها بلا حماية على الإطلاق. وإيلون ماسك لم ير مشكلة أصلا.

ثلاث شركات وثلاثة مواقف، ونتيجة واحدة: 900 ضربة في 12 ساعة، ونحو 2000 ضربة بحلول 100 ساعة، والقصف متواصل. السؤال الذي يطرحه كل هذا ليس من كان على حق، "أنثروبيك" أم "أوبن إيه آي"، ولكن ما دامت التكنولوجيا أزالت كل القيود التشغيلية ضمن سلسلة القتل، وأزال السوق كل القيود الأخلاقية على مزودي تلك التكنولوجيا، فما القيد الأخير المتبقي لوقف كل هذا الدمار؟

القيد الأخير لوقف الدمار

صباح 28 فبراير/شباط، ضربت صواريخ أمريكية أو إسرائيلية مدرسة الشجرة الطيبة الابتدائية للبنات. قتل 165 شخصا، معظمهم فتيات بين السابعة والثانية عشرة. تحقيق الجزيرة بالصور الفضائية وجد أن الصواريخ أصابت القاعدة العسكرية المجاورة والمدرسة، لكنها تجاوزت عيادة طبية تقع بين المنشأتين. هذا الاستثناء لا يمكن تفسيره بالمصادفة، المنفذ كان يعمل بإحداثيات تميز بين المباني، وإسرائيل قالت إنها ليست على علم بضربات في المنطقة، والولايات المتحدة قالت إنها "تحقق في التقارير"، وبعثة تقصي الحقائق الأممية المستقلة بشأن إيران وصفت الضربة بأنها تثير "صدمة عميقة" ودعت إلى تحقيق فوري.

لم تكن تلك حادثة معزولة؛ فبحلول الخامس من مارس/آذار، تضررت 13 منشأة صحية إيرانية من الضربات طبقا لمنظمة الصحة العالمية. قصف مبنى مدرسة ثانية شمالي غرب إيران، وأصيب البازار الكبير وقصر غلستان التاريخي، وقد اتهمت وزارة الخارجية الإيرانية الولايات المتحدة وإسرائيل بأنهما "تستمران في قصف المناطق السكنية بلا تمييز".

"التكنولوجيا لم تقرر ضرب المدرسة، لكنها ربما أنتجت المنظومة التي تجعل ضرب المدارس نتيجة منطقية حين تعالج آلاف الأهداف بسرعة الآلة"

لا يمكننا إثبات أن الذكاء الاصطناعي أنتج إحداثيات مدرسة ميناب تحديدا، فلا توجد وثيقة مسربة تربط هذه الضربة بمنظومة "مافن" أو نموذج "كلود"، لكننا نعرف أن المنظومة التي أنتجت 900 هدفا في 12 ساعة هي ذاتها المنظومة التي كانت تعمل حين قصفت القوات الأمريكية والإسرائيلية المدرسة.

في كل حرب سابقة، فرضت قيود متعددة حدا أقصى على حجم الدمار، مثل القدرة اللوجستية، وتوافر الذخيرة، وعدد الطائرات، وسرعة التخطيط، والسعة المعرفية للمحللين البشريين. الذكاء الاصطناعي أزال آخر هذه القيود وأكثرها جوهرية وهو القيد المعرفي، فحين يستطيع النظام إنتاج آلاف الأهداف يوميا بملفات متكاملة، يصبح القيد الوحيد المتبقي هو الإرادة السياسية لمن يأمر بتنفيذ الضربات.

ولكن، وفق ما شهدناه، فإن الإرادة السياسية لم تكن يوما حامية موثوقة لحياة المدنيين. يصوغ جون فيليبس، مستشار أمني بريطاني ومدرب عسكري سابق، الأمر للجزيرة، فيقول إن الولايات المتحدة تستطيع الحفاظ على الإيقاع الحالي من الضربات والانتشار الجوي والبحري لفترة أطول بكثير من أي طرف إقليمي، بالنظر إلى قاعدتها الصناعية. القيد الملزم هو الإرادة السياسية المحلية وترتيب الأولويات الاستراتيجية.

هنا يتقاطع الذكاء الاصطناعي مع السياسة؛ التكنولوجيا لم تقرر ضرب المدرسة، لكنها أنتجت المنظومة التي تجعل ضرب المدارس نتيجة إحصائية حين تعالج آلاف الأهداف بسرعة الآلة. ربما هذا ما كشفته الحرب على إيران؛ ليس أن الذكاء الاصطناعي يحارب من تلقاء نفسه، بل أنه يمكن الدمار بنطاق يجعل الرقابة البشرية أقرب إلى مسرحية قانونية. الحكومات الغربية تقدم الحرب بمساعدة الذكاء الاصطناعي على أنها أكثر دقة، بينما الواقع أنها تمكن الدمار الواسع مع الحفاظ على البنية البيروقراطية لاستهداف "مدروس" و"قانوني" شكليا.

في ميناب، انتشل عمال الإنقاذ جثث 165 شخصا من تحت الأنقاض، لكن المدرسة ليست استثناء في هذه القصة. إنها النتيجة المنطقية لمنظومة صممت لتنتج 900 ضربة في 12 ساعة، فحين يصبح كل شيء هدفا محتملا، يتوقف سؤال "هل يجب أن نضرب هذا الهدف؟" عن كونه سؤالا يطرح فعلا، ويصبح مجرد خانة أخرى تعبأ بسرعة الآلة.

"لم يعد التخطيط هو الحد، ولم تعد المعالجة هي الحد، ولم تعد المراجعة القانونية هي الحد. كل هذه أصبحت وظائف تؤديها الآلة بسرعة لا يستطيع الإنسان مجاراتها ولا الاعتراض عليها في الوقت المناسب"

ما كشفته الحرب على إيران ليس أن الذكاء الاصطناعي يمكنه المشاركة في الحرب، هذا كان واضحا منذ الحرب على قطاع غزة، لكن ربما ما كشفته هذه المرة أن الذكاء الاصطناعي أزال آخر قيد تشغيلي على حجم الدمار. لم يعد التخطيط هو الحد، ولم تعد المعالجة هي الحد، ولم تعد المراجعة القانونية هي الحد. كل هذه أصبحت وظائف تؤديها الآلة بسرعة لا يستطيع الإنسان مجاراتها ولا الاعتراض عليها في الوقت المناسب.

بقي قيد وحيد وهو أن يقرر الإنسان نفسه أن يتوقف، ليس لأن المنظومة عاجزة، بل لأنه يرى أن حجم الدمار كاف. المعضلة أن هذا القيد لم ينجح قط في حماية المدنيين حين كانت القدرة محدودة سابقا. فكيف سينجح الآن، بعد أن أصبحت تلك القدرة بلا حدود؟

المصدر:

الجزيرة

المصدر:

الجزيرة