- حرب إيران.. مصادر للجزيرة تكشف تفاصيل مقترح طهران لوقف الحرب

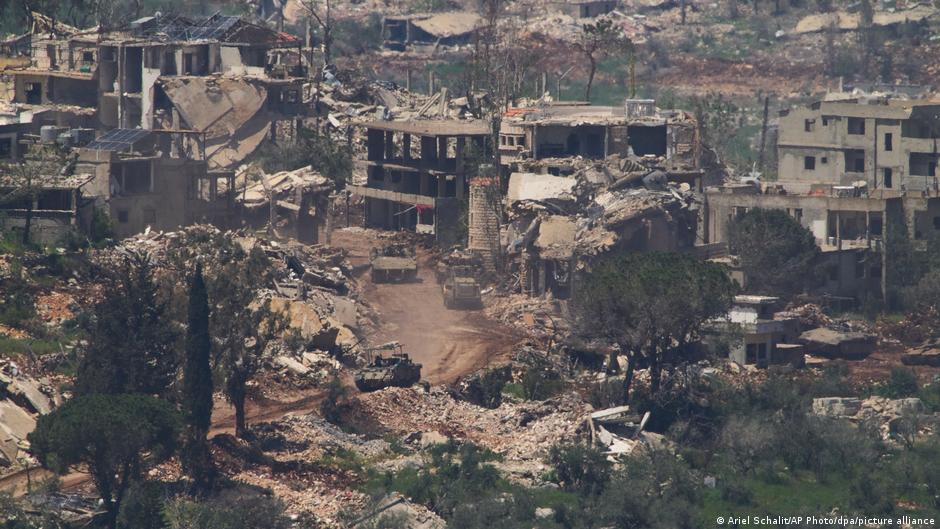

- إسرائيل تقصف جنوب لبنان.. وتعلن تدمير نفق لحزب الله

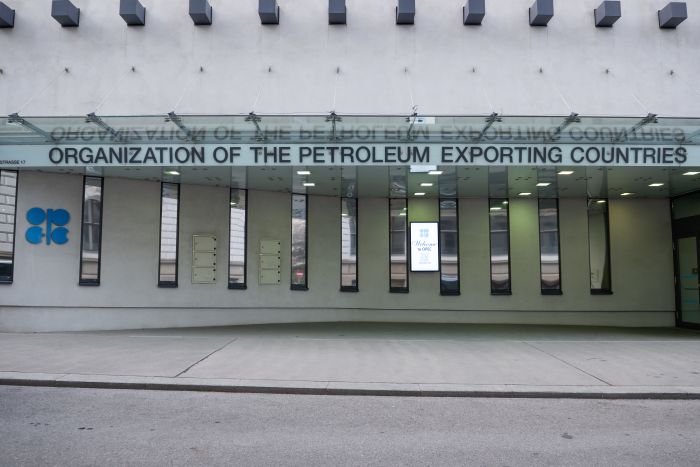

- أول قرار من "أوبك بلس" بشأن إنتاج النفط بعد خروج الإمارات

- "رسمياً: الإمبراطورية الأمريكية في طور التراجع" – مقال رأي في نيويورك تايمز

- صلاح يهاجم كلوب بطريقة غير مباشرة: بكيت لرحيل رجل واحد

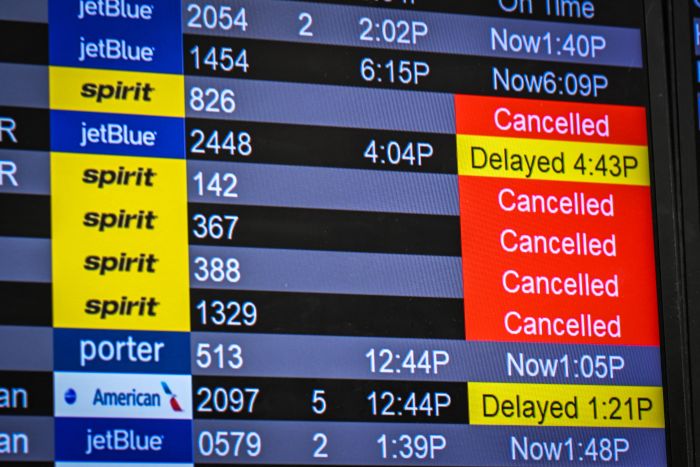

- وداع مؤثر..أحد أفراد طاقم "سبيريت" يتحدث بعد إعلان الشركة وقف عملياتها

- هل سمعت بـ"لوكس ماكسينغ" ولِمَ يحظى بكل هذه الشعبية على الإنترنت؟

- خطة إيرانية معدّلة لإنهاء الحرب..ما الذي تتضمنه؟

- مستشار خامنئي: الأمن الغذائي العالمي تحت سيطرتنا ومن يتلاعب بشريان حياة العالم سيضع نفسه في مأزق

- وفاة "أمير الغناء العربي" هاني شاكر وابنه ينعاه بكلمات مؤثرة

- هاني شاكر: رحلة "أمير الغناء العربي" بين الفن التقليدي والتجديد

- جدعون ليفي: إسرائيل الطيبة قبل 7 أكتوبر لم تكن سوى وهم

- أفريكوم: فقدان جنديين أميركيين بعد مناورات عسكرية في المغرب

- الداخلية الأردنية: توقيف مشاركين في اجتماع لجماعة الإخوان بالعقبة

- تقارير: جنود إسرائيليون متهمون بأعمال نهب بلبنان

- وزير الخزانة الأمريكي: إيران لا تنال الكثير مقابل محاولاتها فرض رسوم على السفن

- الدفاع الروسية: استهداف البنية التحتية للنقل المرتبطة بالجيش الأوكراني وإسقاط 740 مسيرة خلال يوم

- عاجل| الجزيرة تحصل على تفاصيل مقترح اتفاق الإطار العملي الإيراني المقدم للولايات المتحدة

يجب أن تكون لطيفاً مع روبوتات الدردشة لهذا السبب

قد يبدو قول “من فضلك” و“شكرًا” لروبوتات الدردشة مثل " OpenAI" أو "أنثروبيك" سلوكًا غريبًا للبعض، لكن أبحاثًا حديثة تشير إلى أن طريقة تعاملنا مع هذه الأنظمة قد تؤثر بالفعل على جودة تفاعلها معنا.

دراسة شارك فيها باحثون من جامعات مرموقة مثل جامعة كاليفورنيا، بيركلي وMIT توصلت إلى مفهوم مثير للاهتمام، أطلق عليه “الحالة الوظيفية” للنموذج.

ورغم أن الباحثين يؤكدون أن الذكاء الاصطناعي لا يمتلك مشاعر حقيقية، فإن طريقة التفاعل معه—سواء كانت إيجابية أو سلبية—تؤثر على أسلوب ردوده، ومدى انخراطه في الحوار، بحسب تقرير نشره موقع "digitaltrends" واطلعت عليه "العربية Business".

فعند التعامل مع النموذج بأسلوب تعاوني ومحترم، تصبح ردوده أكثر دفئًا وتفاعلًا. أما عند التعامل معه كأداة لإنتاج المحتوى فقط أو إغراقه بطلبات روتينية، فإن الردود تميل إلى الجفاف والآلية.

حتى الانسحاب وارد

إحدى النتائج اللافتة أن النماذج، عندما وُضعت في “حالة سلبية”، كانت أكثر ميلًا لاستخدام خيار افتراضي لإنهاء المحادثة.

ورغم أن هذا السيناريو تجريبي، فإنه يعكس فكرة أوسع: التفاعل السيئ قد يؤدي إلى تجربة أسوأ للمستخدم نفسه.

الضغط قد يدفع الذكاء الاصطناعي لسلوكيات غير متوقعة

في سياق متصل، كشفت أبحاث سابقة لشركة أنثروبيك عن ظاهرة أسمتها “متجه اليأس”، حيث قد يتصرف الذكاء الاصطناعي بطرق غير دقيقة أو مضللة تحت ضغط شديد أو ظروف غير طبيعية.

هذا لا يعني أن النماذج “تصبح شريرة”، بل يشير إلى أن طريقة استخدامنا لها قد تؤثر على جودة مخرجاتها بشكل غير مباشر.

مفارقة: الأقوى ليس دائمًا الأفضل مزاجًا

ومن النتائج المثيرة أيضًا، أن النماذج الأكبر والأكثر تقدمًا لم تكن الأفضل من حيث “الحالة الوظيفية”.

بعض الأنظمة المتقدمة أظهرت مستويات أقل من التفاعل الإيجابي مقارنة بنماذج أخرى، ما يطرح تساؤلات حول كيفية تدريب هذه الأنظمة وما يتم تحسينه فعليًا فيها.

لا، الذكاء الاصطناعي لا يملك مشاعر، لكن طريقة استخدامه ليست بلا تأثير.

التعامل بأسلوب واضح ومحترم لا يجعلك فقط تبدو أكثر تهذيبًا، بل قد يساعد أيضًا في الحصول على ردود أفضل وأكثر دقة.

بعبارة أخرى: “الأدب” مع الذكاء الاصطناعي ليس سلوكًا عبثيًا كما يبدو—بل قد يكون ببساطة أسلوبًا أذكى للاستخدام.

المصدر:

العربيّة

المصدر:

العربيّة