- صاروخ يمني يوقف مطار " بن غوريون " و دوي صفارات الإنذار

- التطورات في سوريا.. غارات إسرائيلية على دمشق وواشنطن تتحدث عن توجه لخفض التصعيد

- مصر.. وفاة المدرب ميمي عبد الرازق والأهلي والزمالك ينعيانه

- حزب "شاس" يستقيل من حكومة نتنياهو دون الخروج من الائتلاف

- الزبيدي يعلن تأييده للإحتجاجات الشعبية في عدن

- صنعاء تُصعّد في البحر .. هجمات دقيقة ومعقدة تؤكد فشل الردع الأمريكي والإسرائيلي

- وزير الخارجية يلتقي رئيس بعثة الاتحاد الأوروبي

- المقاومة الوطنية تضبط شحنة اسلحة استراتيجية إيرانية كانت في طريقها للميليشيات الحوثية

- نماء تحتفي بتخريج 250 لاجئا ولاجئة

- البركاني يجري اتصالاً هاتفياً بالعميد طارق صالح ويشيد بجهود القبض على أسلحة إيرانية كانت في طريقها إلى المليشيات الحوثية

- مجلس الوزراء يناقش تطورات الأوضاع الاقتصادية والمالية والخدمية والجهود المنسقة لإحباط مخططات مليشيا الحوثي

- بيلينغهام يجري عملاً جراحياً.. إليك مدة غيابه عن الملاعب

- إدانات للقصف الإسرائيلي وواشنطن تدعو تل أبيب للحوار مع دمشق

- لبنان في مرمى الضغوط الأميركية.. سباق السلاح يشعل البرلمان

- البحرين وأميركا توقعان اتفاقية بشأن الطاقة النووية السلمية

- سرايا القدس تبث مشاهد تفجير دبابة والاحتلال يعلن إصابة أحد جنوده

- حفيدة الشيخ مرهج شاهين تحمل مسؤولية وفاته لقوات الحكومة بعد ظهوره في فيديو يحلق فيه عسكريون شاربه

- رئيس دولة الإمارات ونظيره التركي يبحثان مستجدات المنطقة

حماية الهوية الشخصية من التزييف: قوانين تتسابق مع الذكاء الاصطناعي

مصدر الصورة

مصدر الصورة

قبل أسابيع فقط، اكتشف بول ديفيس، البريطاني البالغ 43 عاماً، تعرّضه للخداع بعدما اعتقد لأشهر أنّه في علاقة رومانسية مع الممثلة الأمريكية جينيفر أنيستون.

خلال خمسة أشهر، استخدم المخادع المجهول مقاطع فيديو مصنوعة عبر تقنية "الديب فايك" (التزييف العميق) التي تعمل بواسطة الذكاء الاصطناعي، إضافة إلى صور مزيفة لما زعم أنّها رخصة قيادة أنيستون وتسجيلات صوتية لما يبدو أنّه صوت الممثلة، لكي يجعل الضحية يصدّق بأنّه يتواصل فعلاً مع الممثلة.

مقتنعاً تماماً بالخدعة، أرسل ديفيس نحو 200 جنيه استرليني من بطاقة هدايا "أبل" غير القابلة للاسترداد، بحجة تغطية اشتراكات "أبل" الخاصة بأنيستون.

لكن هذه الحادثة ليست الأولى من نوعها.

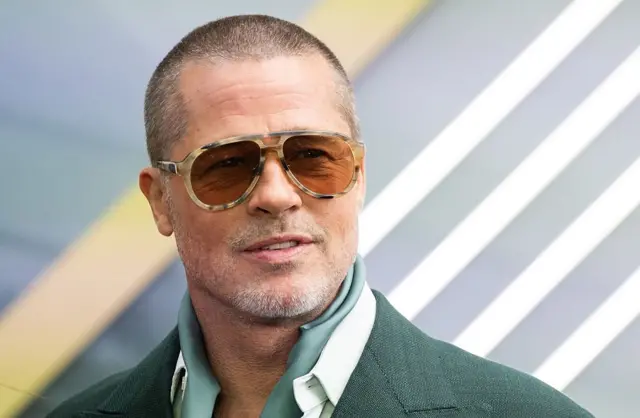

ففي يناير/كانون الثاني الماضي، ضجّ الإعلام الفرنسي بقضيّة تعرّض مصممة ديكور فرنسية تُدعى آن (53 عاماً) لعملية احتيال كبيرة خسرت فيها 830 ألف يورو، بعدما أقنعها محتالون عبر الإنترنت بأنّها تتواصل مع الممثل الأمريكي براد بيت.

وعلى مدى عام ونصف العام، اعتقدت آن أنّها في علاقة عاطفية مع بيت، ليتبيّن لاحقاً أنّها كانت ضحية لتلاعب ممنهج بواسطة تقنيات الذكاء الاصطناعي.

هاتان القصّتان، وغيرهما من الجرائم المشابهة التي ازداد الحديث عنها في الآونة الأخيرة، أظهرتا كيف يمكن لتقنيات التزييف بواسطة الذكاء الاصطناعي، فائقة التطور، أن تؤذي الأشخاص على المستوى المادي والنفسي.

*

*

*

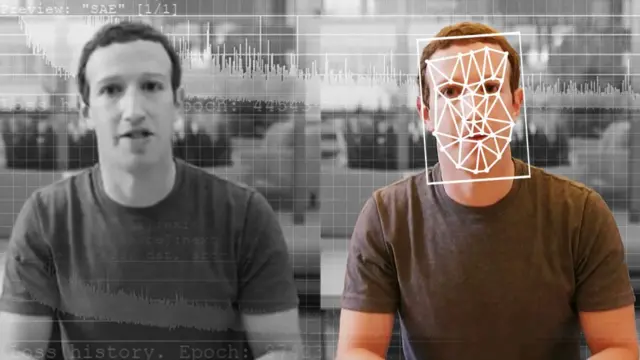

ما هي تقنية "الديب فايك"؟

مصدر الصورة

مصدر الصورة

الديب فايك" أو التزييف العميق هو إنتاج صور بواسطة الذكاء الاصطناعي تحاكي الواقع بدرجة عالية من الدقّة، إلى حدّ أنّ العين البشرية تعجز عن التمييز بين الصور المصنَّعة وبين الصور الحقيقية.

منذ أنْ ظهر مصطلح "الديب فايك" عام 2017، انتشرت هذه التقنية بوتيرة متسارعة، وبلغت في عام 2025 مرحلة مفصلية جديدة.

فلم يعد إنتاج محتوى زائف فائق الواقعية يتطلّب كميات ضخمة من البيانات كما في السابق، بل أصبح من الممكن توليد مقاطع تحاكي صوت وصورة شخص ما بالاعتماد على عيّنة حقيقية محدودة.

تزامناً مع ذلك، أعلنت غوغل خلال مؤتمرها السنوي الأخير عن نموذجها الجديد Google Veo، وهو نظام ذكاء اصطناعي متقدّم قادر على توليد فيديوهات واقعية للغاية انطلاقاً من أوامر نصّية بسيطة.

تعدّ تقنية غوغل من بين أكثر الأدوات تطوراً في هذا المجال حتى الآن، إذ يمكنه فهم السياق البصري والزماني بدقّة، ما يجعل الفرق بين الحقيقي والمزيّف أكثر ضبابية من أي وقت مضى.

وبينما تتعاظم المخاوف، تزداد أيضاً الجهود المبذولة لتطوير أدوات لكشف هذا النوع من المحتوى. لكن المفارقة تكمن في أنّ كل خطوة نحو تطوير أدوات الكشف تُقابَل بتقنيات جديدة تزيد من صعوبة الأمر.

في ظلّ هذا الواقع، يُطرح سؤال كبير عن إمكانية حماية الأشخاص في عالمنا اليوم من التعرّض للاستغلال والتلاعب بواسطة هذه التكنولوجيا.

"حقّ امتلاك الملامح"

مصدر الصورة

مصدر الصورة

الحكومة الدنماركية حاولت الإجابة مؤخراً على هذا السؤال.

في خطوةٍ متقدمة في هذا المجال، اقترحت الحكومة الدنماركية مشروع قانون يهدف إلى حماية المواطنين من "إساءة استخدام الذكاء الاصطناعي"، تحديداً تكنولوجيا "الديب فايك" أو الفيديوهات المزيّفة التي تُظهر أشخاصاً حقيقيين، كما يعرّفها القانون.

ويهدف القانون إلى منع نشر مواد الذكاء الاصطناعي التي تصوّر شخصاً ما من دون موافقته.

المميز في القانون هو أنّه بدلاً من لجوئه فقط إلى عقوبات جنائية في حال الاستخدام الضار لهذه التكنولوجيا، فهو يقترح منح الأفراد الحق القانوني في "امتلاك ملامحهم الشخصية"، أي السيطرة على استخدامها الرقمي، بما في ذلك أصواتهم ووجوههم، ومنع أي استخدام وتوظيف لها من دون موافقتهم، باعتبار ذلك انتهاكاً لحقوق النشر.

بموجب المشروع، سيكون من حق أي فرد أنْ يطلب من منصات التواصل الاجتماعي إزالة المحتوى الضارّ، وستُحمَّل هذه المنصّات مسؤولية التنفيذ، حيث تُفرض عليها غرامات في حال لم تستجب.

كما أنّ ريادة هذا القانون تكمن أيضاً في كونه لا يعاقب المستخدمين الذين ينشرون هذا النوع من المحتوى، بل يستهدف المنصّات نفسها.

وزير الثقافة الدنماركي، ياكوب إنغل-شميدت، قال في حديثٍ إلى صحيفة الغارديان البريطانية: "في نص القانون المقترح، نتفق جميعاً ونوجّه رسالة لا لبس فيها مفادها أنّ لكل فرد الحق في جسده، وصوته، وملامح وجهه الخاصة ــ وهو ما لا يبدو أنّ القانون الحالي يضمنه بشكل كافٍ في مواجهة تقنيات الذكاء الاصطناعي التوليدي".

وأشار إلى أن "التكنولوجيا تجاوزت قوانيننا الحالية"، مؤكداً أنّ المشروع يهدف إلى حماية الخصوصية كحقّ أساسي في العصر الرقمي.

ويشمل القانون، بحسب إنغل-شميدت، استثناءات للأعمال الساخرة والنقد الاجتماعي حفاظاً على حرية التعبير، لكن بعض الخبراء أشاروا إلى "غموض" في هذه المفاهيم، إذ لا يوجد تعريف رسمي لما يُعدّ "ديب فايك"، ولا معيار موضوعي لتحديد ما إذا كان المحتوى ساخراً، ما قد يُدخل النزاعات إلى ساحات القضاء.

وقد يصبح هذا التوجّه الجديد نموذجاً يُحتذى به داخل الاتحاد الأوروبي، إذ ترى الحكومة أنّ القانون الأوروبي الحالي لم يعد كافياً لمواكبة تطوّر التكنولوجيا.

ما هي فعالية القانون في فضاء عابر للحدود؟

مصدر الصورة

مصدر الصورة

وقد أشاد عدد من الخبراء بالمشروع باعتباره خطوة سبّاقة، لكونه لا يركّز على نوع الضرر "بل على مبدأ حماية الهوية الشخصية في العصر الصناعي الرقمي".

ومع ذلك، أعرب هؤلاء عن مخاوف تتعلق بآليات التطبيق، محذّرين من أنّ غياب أدوات تنفيذ فعالة قد يجعل الأثر الواقعي للقانون محدوداً، خصوصاً أنّ معظم الجهات التي تستخدم هذه التكنولوجيا تعمل على مستوى عالمي، بعيداً عن نطاق السلطات المحلية في الدنمارك.

فمعظم الجهات التي تستخدم تقنية "الديب فايك" لأغراض احتيالية أو إباحية أو سياسية لا تعمل داخل الدنمارك، ولا تخضع لقوانينها، ما يجعل من الصعب محاسبتها أو حتى تعقّبها.

من هذا المنطلق، يواجه القانون الدنماركي، كما غيره من المبادرات الدولية، تحدياً جذرياً، وهو الطبيعة العابرة للحدود التي تسم الفضاء الرقمي.

كما أنّ منصات التواصل الكبرى التي تحتضن هذا النوع من المحتوى لا تتخذ دائماً إجراءات فعالة، خصوصاً حين تكون قوانين البلدان غير ملزِمة لها أو حين تكتفي هذه الشركات بالالتزام بمبدأ "حرية النشر".

وبالتالي، فإن غياب آليات تنفيذ دولية أو تعاون قضائي وتقني عابر للحدود قد يجعل من هذه القوانين مجرّد أدوات رمزية، لا تغيّر كثيراً في الواقع الذي تفرضه التكنولوجيا على الناس.

في هذا السياق، يقول المدير التنفيذي لمنظمة الحقوق الرقمية "سمكس"، محمد نجم، إنّ القانون - على الرغم من أهميته - من الصعب أنْ يضع حدّاً نهائياً للاعتداءات التي قد تحصل بواسطة الذكاء الاصطناعي. وهو أمرٌ مشابهٌ لوضع القانون الخاص بالذكاء الاصطناعي الصادر عن الاتحاد الأوروبي عام 2023، إذ إنّه غير كافٍ لتغطية كل التعقيدات الناتجة عن الذكاء الاصطناعي وانتشاره الحالي، وهو ما تبحثه بروكسل لتطوير القانون بشكل أكبر وأشمل.

سباق تشريعي لاحتواء الضرر

مصدر الصورة

مصدر الصورة

وكانت دول أخرى قد اعتمدت بعض التدابير الحمائية التي حاولت مواكبة الانتشار الجماهيري لأدوات الذكاء الاصطناعي في السنوات القليلة الماضية.

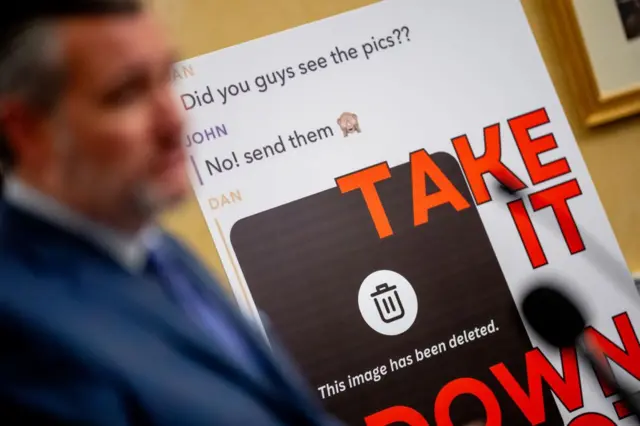

في مايو/أيار الماضي، أقرّت الولايات المتحدة قانون "Take It Down" (أزِلها)، والذي يُجرّم الصور المُزيفة المنتَجة عبر الذكاء الاصطناعي من دون موافقة أصحابها، ويُلزم منصّات التواصل الاجتماعي بإزالة هذا النوع من المحتوى خلال 48 ساعة من تلقيها إشعاراً بوجوده.

كما تبنّت ولايات أمريكية عدة قوانين ترمي إلى حماية الأصوات والوجوه من الاستنساخ عبر الذكاء الاصطناعي، مثل قانون "إلفيس" في ولاية تينيسي.

وفي الاتحاد الأوروبي، دخل "قانون الذكاء الاصطناعي" حيّز التنفيذ في أغسطس/آب 2024، وهو يعد أول إطار شامل ينظم استخدام الذكاء الاصطناعي "وفقاً لمستويات الخطورة".

أما في المملكة المتحدة، فإنّ "قانون الأمان على الإنترنت" يهدف إلى "السيطرة على المحتوى الضار الناتج عن الذكاء الاصطناعي"، كما تدرس الحكومة قوانين إضافية تخصّ المحتوى الإباحي المُزيّف.

ومن جهتها، شددت كوريا الجنوبية في عام 2024 عقوبات التزييف العميق غير التوافقي، بخاصة حين يتعلق الأمر بالأشخاص القُصّر.

كذلك، تعمل حالياً دول أخرى مثل كندا، والبرازيل، والفلبين وغيرها على مشاريع قوانين لضبط استخدام الذكاء الاصطناعي.

أسئلة حول أفق هذه القوانين

برغم أهمية القوانين المقترحة حول العالم لمواجهة ضرر التزييف العميق وتكنولوجيا الذكاء الاصطناعي بشكل عام، هناك تساؤلات شائكة تتعلق ليس فقط بفعالية هذه القوانين بل بحدودها الأخلاقية والإبداعية أيضاً.

ففي حين يمنح القانون الدنماركي استثناءات محدودة للأعمال الساخرة والنقد الاجتماعي، في محاولة للموازنة بين حماية الأفراد وحرية التعبير، تبقى المفاهيم التي يستند إليها القانون غامضة وغير محددة. فلا يوجد تعريف قانوني واضح لما يُعدّ "ديب فايك"، ولا معيار دقيق يميّز بين ما يُعتبر فناً نقدياً مشروعاً، وما يُصنَّف كتشويه متعمّد لسمعة الآخر.

ماذا لو نشر ناشط سياسي فيديو مزيّفاً لشخصية عامة في سياق تهكمي أو احتجاجي؟ من يملك سلطة الحُكم على هذا المحتوى؟ وأي معايير ستُستخدم للفصل بين الإبداع والتضليل؟ هذه المنطقة الرمادية قد تفتح الباب أمام صراعات قضائية طويلة، لا سيما في البلدان التي تعاني أنظمتها القضائية من البطء أو التسييس، ما يهدد بتقويض حرية التعبير بدل حمايتها.

وفي الولايات المتحدة، يشير خبراء إلى أن هذه الإشكالية تزداد تعقيداً بسبب التعديل الأول للدستور الأمريكي، الذي يحمي حرية التعبير، حتى حين تكون هذه الحرية على حساب صورة الآخر. لذلك فإنّ استخدام فيديو مزيّف في سياق ساخر أو تعليقي قد يظل قانونياً بغضّ النظر عن أي ضرر معنوي ناجم عنه.

وفي سياق موازٍ، تبرز أيضاً أسئلة بشأن "الذات الرقمية" وإمكانية ملكيتها فعلاً في وقتٍ تنتشر بيانات الأفراد في الفضاء الرقمي بشكلٍ واسعٍ جداً قد يتخطّى في أحيانٍ كثيرة حدود إرادتهم ومعرفتهم.

ففي حين تجمع الحكومات والشركات الخاصة البيانات البيومترية – من تقنية التعرف على الوجه في المطارات إلى تحليل الصور الشخصية على منصات التواصل – هل لا يزال ممكناً حماية المعلومات والبيانات الخاصة والسيطرة على تداولها؟

المصدر:

بي بي سي

المصدر:

بي بي سي