- استشهاد نايف سمارو في نابلس لحظة ولادة ابنه الأول

- حرب إيران.. مصادر للجزيرة تكشف تفاصيل مقترح طهران لوقف الحرب

- إسرائيل تقصف جنوب لبنان.. وتعلن تدمير نفق لحزب الله

- أول قرار من "أوبك بلس" بشأن إنتاج النفط بعد خروج الإمارات

- صلاح يهاجم كلوب بطريقة غير مباشرة: بكيت لرحيل رجل واحد

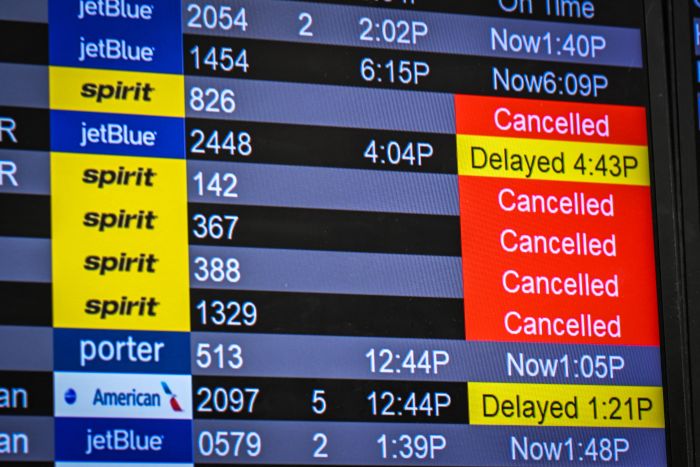

- وداع مؤثر..أحد أفراد طاقم "سبيريت" يتحدث بعد إعلان الشركة وقف عملياتها

- استشهاد شاب وإصابة العشرات برصاص الاحتلال في نابلس

- استشهاد نايف سمارو وإصابة 45 فلسطينياً في اقتحام نابلس

- خطة إيرانية معدّلة لإنهاء الحرب..ما الذي تتضمنه؟

- "رسمياً: الإمبراطورية الأمريكية في طور التراجع" – مقال رأي في نيويورك تايمز

- مستشار خامنئي: الأمن الغذائي العالمي تحت سيطرتنا ومن يتلاعب بشريان حياة العالم سيضع نفسه في مأزق

- وفاة "أمير الغناء العربي" هاني شاكر وابنه ينعاه بكلمات مؤثرة

- هاني شاكر: رحلة "أمير الغناء العربي" بين الفن التقليدي والتجديد

- جدعون ليفي: إسرائيل الطيبة قبل 7 أكتوبر لم تكن سوى وهم

- أفريكوم: فقدان جنديين أميركيين بعد مناورات عسكرية في المغرب

- الداخلية الأردنية: توقيف مشاركين في اجتماع لجماعة الإخوان بالعقبة

- تقارير: جنود إسرائيليون متهمون بأعمال نهب بلبنان

- وزير الخزانة الأمريكي: إيران لا تنال الكثير مقابل محاولتها فرض رسوم على السفن

وداعا للعنصر البشري.. كيف يغير الذكاء الاصطناعي قواعد لعبة التوظيف؟

لم يعد البحث اليوم عن عمل مقتصرا على إرسال السيرة الذاتية أو الإجابة عن أسئلة مدير بشري، فقد تحول جزء كبير من هذه العملية إلى صندوق أسود رقمي، حيث باتت خوارزميات الذكاء الاصطناعي هي الحارس الأول للبوابة المهنية، ويفتح مثل هذا التحول التقني، الذي تبرره الشركات بحجم الطلبات الهائل، نقاشا حادا حول حدود الأتمتة والعدالة والأخلاقيات الرقمية.

التوظيف في عصر "الخوارزميات"

كشف تقرير حديث لصحيفة "الغارديان" (The Guardian) البريطانية، عن اتساع الفجوة بين طموحات الشركات التقنية وتجارب الباحثين عن عمل، حيث أظهرت البيانات أن نحو 47% من الباحثين عن عمل في المملكة المتحدة قد خضعوا بالفعل لمقابلات توظيف يديرها الذكاء الاصطناعي، والأكثر دلالة هو أن 30% من المرشحين قرروا الانسحاب تماما من عملية التوظيف بمجرد معرفتهم بوجود هذا النوع من المقابلات، مما يشير إلى أزمة ثقة حقيقية بين الطرفين.

مصدر الصورة

مصدر الصورة

ماذا يحدث داخل "المقابلة الآلية"؟

من الناحية التقنية، لا تكتفي هذه الأنظمة بتسجيل الإجابات، بل تعمل وفق نماذج معقدة متعددة الأبعاد، حيث تحلل الخوارزميات الكلمات المفتاحية، وتماسك الأفكار، وحتى استخدام "المصطلحات المهنية" المحددة مسبقا، مما يحول المقابلة إلى عملية "حشو كلمات" بدلا من تقييم للشخصية.

كما تعمل على تحليل النبرة والسمات، حيث تحاول الأنظمة المتقدمة تحليل "نبرة الصوت" و"سرعة الحديث" وحتى "تعابير الوجه" رغم الجدل العلمي حول دقتها، وهذه الأدوات تسعى لتقدير السمات الشخصية مثل الثقة أو الذكاء العاطفي، لكنها غالبا ما تفشل في استيعاب التنوع الثقافي أو الاختلافات في أساليب التواصل.

كما أشار أحد المشاركين في تحقيق لصحيفة "الغارديان" إلى أن هذه الأنظمة تعاني من غياب التفاعل الديناميكي، فالذكاء الاصطناعي غالبا ما يفتقر إلى القدرة على فهم "الصمت التأملي" أو "الاستطراد السياقي"، حيث تقاطع الأنظمة المرشحين إذا توقفوا للحظة للتفكير، وهو ما يقتل العفوية والعمق في الإجابة.

مصدر الصورة

مصدر الصورة

تحديات تعجز عنها الخوارزميات

لكن المشكلة الأخطر -حسب ما قال بعض المشاركين في التجربة- تكمن في أن هذه الخوارزميات تتدرب على بيانات تاريخية قد تحتوي على تحيزات ضد مجموعات معينة، وعندما تُستخدم لفلترة المتقدمين، فإنها قد تعيد إنتاج نفس التحيزات بشكل آلي ومستتر، مما يقلل من فرص الأشخاص الذين لا تتطابق "بصمتهم الرقمية" مع النموذج المثالي الذي حدده المبرمجون.

إضافة إلى العجز عن تقييم "غير النمطي"، فالتجارب الشخصية، مثل تلك التي ذكرها أحد المشاركين بخصوص الصعوبات التي يواجهها أصحاب التفكير المختلف مثل "طيف التوحد" مع هذه الأنظمة، تُظهر بوضوح أن الذكاء الاصطناعي يفضل الإجابات النمطية "المعلبة"، ويعاقب أي تفكير إبداعي أو تحليلي يتطلب وقتا أو سياقا خاصا.

مصدر الصورة

مصدر الصورة

إنسان في الحلقة

ويضع التقرير الشركات أمام مسؤولية أخلاقية، وهي أن الأتمتة لغرض الكفاءة يجب ألا تأتي على حساب "جودة التوظيف"، حيث أوضح أن بعض التوصيات الحالية تتجه نحو الشفافية الكاملة، وأنه يجب على الشركات الإفصاح عن معايير التقييم وكيفية استخدام الذكاء الاصطناعي، وتوفير بديل بشري لمن يجدون صعوبة في التعامل مع الأنظمة الآلية.

إضافة إلى المراجعة البشرية، بحيث يكون استخدام الذكاء الاصطناعي فقط كأداة مساعدة لا لاتخاذ قرار الرفض أو القبول النهائي بشكل أعمى.

وبينما يرى أصحاب العمل حلا سحريا في الأتمتة لزحام الطلبات، يرى المرشحون فيها "جدارا رقميا" يفتقر للحكمة والإنصاف، فيما يقول المراقبون إن مستقبل التوظيف الناجح لن يكون في "أتمتة البشر"، بل في استخدام التكنولوجيا لتعزيز القدرة البشرية على الاختيار، لا لاستبدالها.

المصدر:

الجزيرة

المصدر:

الجزيرة