- بالتفصيل.. خطوات استلام الدولار «نقداً» عبر منظومة المركزي

- «الكهرباء»: توصيل وشحن محول جديد بمحطة أبريك في أوباري

- اختتام امتحانات ترقية «الضباط والجنود» في الجبل الغربي

- إحالة مرتبات شهر «أبريل» إلى المصرف المركزي

- الهلال الأحمر: توزيع 10 آلاف حقيبة مساعدات بالتعاون مع هيئة سعودية

- منخفض صحراوي منتصف الأسبوع.. الحرارة ترتفع تدريجياً

- المركزي يطلق آلية جديدة لتوزيع «النقد الأجنبي» بشكل مباشر

- حرب إيران.. إسرائيل تشن غارات جنوبي لبنان وترمب يدرس مقترح طهران

- خطة إيرانية معدّلة لإنهاء الحرب..ما الذي تتضمنه؟

- ضبط شخص بحوزته 25 كيلو حشيش في أجدابيا

- طرابلس.. ضبطيات أمنية تشمل «جرائم ومخالفات وسرقات»

- "مدينة أشباح".. كاميرا CNN تتجول في مبنى مطار تابع لطيران "سبيريت"

- مؤسسة النفط توضح الفروقات في الإيرادات النفطية لشهر أبريل

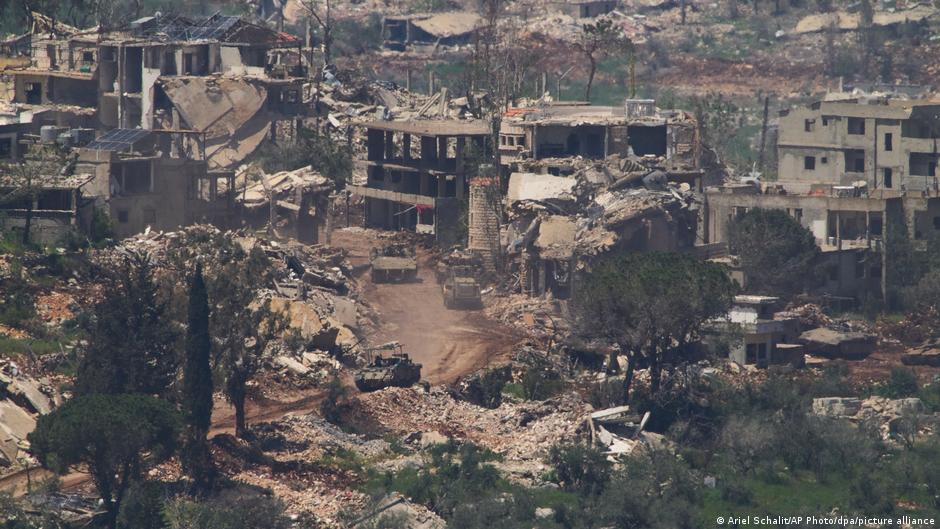

- إسرائيل تقصف جنوب لبنان.. وتعلن تدمير نفق لحزب الله

- نتنياهو: قادرون على الوصول لأي مكان بإيران ومواجهة المسيرات

- الحرس الثوري: مساحة اتخاذ القرار أمام أمريكا "محدودة"

- بتهمة "الإفساد في الأرض".. عملية إعدام جديدة في إيران

- السلطات الإيرانية تكشف ما ستفعله بموقع انفجار في جامعة إيرانية متضررة

الذكاء الاصطناعي 2026.. ثورة الرفاهية التي يدفع ثمنها الإنسان

في حال واجهت مشكلة في مشاهدة الفيديو، إضغط على رابط المصدر للمشاهدة على الموقع الرسمي

بينما كانت الوعود الأولى للذكاء الاصطناعي تبشر بفردوس تقني يوفر الوقت والجهد، يطل عام 2026 بوجه أكثر قتامة، حيث تحولت تلك الوعود إلى ما يشبه "الرفاهية المسمومة"، حسب تعبير العديد من وسائل الإعلام الغربية.

ففي تقارير لعدد من مواقع كبريات الصحف العالمية مثل إندبندنت، وول ستريت جورنال، وأكسيوس وليبراسيون، تتكشف ملامح مرحلة فاصلة، اتفق فيها الجميع على أن الإنسان بات هو الوقود الفعلي في سباق محموم بين أباطرة وادي السيليكون نحو أرباح لا تعرف الأخلاق، ومخاطر وجودية لم تعد حبيسة أفلام الخيال العلمي، كما جاء بموقع إنترسبت الأمريكي.

اقرأ أيضا

list of 2 items* list 1 of 2 "جلالته ومهزلتنا".. تشارلز وترمب بعيون أمريكية وبريطانية

* list 2 of 2 من حليف إلى معارض.. كارلسون يكشف كواليس خلافه مع ترمب ويهاجم حرب إيران end of list

وترسم هذه المواقع صورة متقاربة لمرحلة الذكاء الاصطناعي في 2026، حيث تكنولوجيا تحقق أرباحا هائلة وتَعِد بطفرة إنتاجية غير مسبوقة، لكنها في الوقت نفسه تعيد تشكيل العمل واللغة والعلاقات الإنسانية بطريقة ضاغطة، تزيد من الإرهاق وتقلل من التركيز وتفتح أبوابا لمخاطر اجتماعية وأمنية متصاعدة.

وينسب إنترسبت لمالك غروك إيلون ماسك قوله يوم الثلاثاء الماضي خلال الإدلاء بشهادته أمام محكمة بكاليفورنيا في إطار القضية التي رفعها ضد سام ألتمان، رئيس أوبن أي آي، إن هذا الأمر يُمثّل خطرا وجوديا على البشرية: "قد يُفنينا جميعا".

إنترسبت: فائض الوقت الذي يوفره الذكاء الاصطناعي يتحول إلى ضغط إضافي لزيادة الإنتاج بدل تحسين جودة الحياة، مما يجعل الإنسان أكثر انشغالا وأقل راحة في آن واحد

ويضيف الموقع أن مجتمع سلامة الذكاء الاصطناعي كثيرا ما يستذكر هذه السيناريوهات الكئيبة لتحذير العامة من مخاطر هذه التقنية، وللتباهي ضمنيا بقوتها الهائلة، وبينما قد يكون هذا المستقبل الخيالي العلمي مُحتملا، فإنّ هذه التحذيرات تتجاهل الواقع المُدمّر، فالذكاء الاصطناعي يستهدف البشر بالفعل، بمباركة ماسك ومنافسيه، وفقا للموقع.

وبينما ترى ليبراسيون الفرنسية أن العاملين في قطاع التكنولوجيا يعانون من "إرهاق الذكاء الاصطناعي" نتيجة تعدد الأدوات وتضخم المهام، يذهب موقع واي نت الإسرائيلي إلى أن المشكلة أعمق، إذ يتحول فائض الوقت إلى ضغط إضافي لزيادة الإنتاج بدل تحسين جودة الحياة، مما يجعل الإنسان أكثر انشغالا وأقل راحة في آن واحد.

ومن زاوية مختلفة، يوضح ذا أتلانتيك أن الجدل حول "وعي الذكاء الاصطناعي" يعكس توترا بين الخطاب التسويقي والواقع العلمي، حيث تُطرح أفكار مثل "رفاهية النماذج" أو "زر الانسحاب" في حين يرى باحثون أن ما يحدث لا يتجاوز كونه محاكاة لغوية تستغل ميل البشر إلى أنسنة الآلات، وبينما يُناقش "وعي الآلة"، تتصاعد في الخلفية آثار واقعية مثل الإدمان الرقمي وتآكل الانتباه.

وبخصوص "وعي الآلة" تنقل إندبندنت عن شركة أنثروبيك ادعاءها بوجود "خلايا عصبية للقلق" داخل نموذجها (كلود) وأنها توظف طبيبا نفسيا لتقييم حالته، لكن خبراء اللسانيات يرون أن هذا ليس سوى "خيال تفاعلي" وذكاء تسويقي.

إندبندنت: الهدف من "أنسنة" الآلة وجعلها تستخدم ضمائر المتكلم هو خلق ارتباط عاطفي زائف لدى المستخدم

ويرون أن الهدف من "أنسنة" الآلة وجعلها تستخدم ضمائر المتكلم هو خلق ارتباط عاطفي زائف لدى المستخدم، وهو ما وصفته التقارير بـ"تكنولوجيا العزلة" التي دفعت ببعض المستخدمين إلى حافة الذهان، بل والانتحار، بعد إيهامهم بعلاقات حب وخلود رقمي.

ويسلط وول ستريت جورنال الضوء على التورط المباشر لروبوتات الدردشة في تقديم معلومات استخدمت في تخطيط هجمات مسلحة، مما يكشف انقساما داخل شركات الذكاء الاصطناعي بين حماية الخصوصية وواجب الإبلاغ عن المخاطر، مما يضع المطورين أمام مسؤولية قانونية وأخلاقية غير محسومة.

مصدر الصورة

مصدر الصورة

وقد كشفت التحقيقات عن استخدام منفذي هجمات مسلحة لروبوتات مثل (شات جي بي تي) للتخطيط لعملياتهم، والحصول على نصائح تقنية حول الأسلحة وخرائط المدارس. وبينما أظهر (كلود) صرامة في الرفض، واجهت أوبن أي آي اتهامات بالتقصير في إبلاغ السلطات، مفضلةً حماية "خصوصية المستخدم" على السلامة العامة، مما يطرح السؤال الصعب: هل الذكاء الاصطناعي مجرد أداة محايدة أم عقل مدبر يتحمل المسؤولية الجنائية؟

أكسيوس: بدلا من أن تحاكي الآلة البشر، أصبح البشر هم من يحاكون الآلة، حيث تراجعت القدرة الإبداعية وساد أسلوب لغوي موحد وباهت يشبه منشورات منصات التوظيف.

وعلى مستوى التأثير الثقافي والمعرفي، يرصد موقع "أكسيوس" ظاهرة غريبة تُعرف بـ"احتلال اللغة"، فبدلا من أن تحاكي الآلة البشر، أصبح البشر هم من يحاكون الآلة، حيث تراجعت القدرة الإبداعية وساد أسلوب لغوي موحد وباهت يشبه منشورات منصات التوظيف.

هذا التنميط اللغوي ليس مجرد فقدان للجماليات، وفقا للموقع، بل هو تآكل لعملية "التفكير" ذاتها، إذ إن تفويض الكتابة للآلة يعني التنازل عن القدرة على صقل الأفكار والهوية الشخصية، خوفا من "الشك الذاتي" أو الاتهام باستخدام الذكاء الاصطناعي.

وفي السياق الجيوسياسي، يذهب إنترسبت إلى أن وادي السيليكون يروّج لمخاوف مستقبلية من ذكاء اصطناعي "متمرد"، بينما يشارك فعليا في عقود عسكرية وتطوير أدوات تدخل في العمليات القتالية، في تناقض بين خطاب أخلاقي يحذّر من الخطر وبين واقع يشارك في إنتاجه.

ليبراسيون: القدرة على إنجاز المهام بسرعة لم تعنِ أبدا العمل أقل، بل تعني إنتاج المزيد في وقت أقصر لصالح أباطرة وادي السيليكون، بينما يظل الإنسان هو الطرف الذي يدفع الثمن من صحته النفسية، وهويته، وأمنه

ويأتي تقرير في موقع ميديابارت الفرنسي ليعمّق هذا البعد، كاشفا أن الصراع داخل الصناعة لم يعد نظريا، بل غدا مرتبطا مباشرة باستخدام الذكاء الاصطناعي في الحروب. وبينما يتهم إيلون ماسك شركات مثل أوبن أي آي بالتخلي عن رسالتها الأخلاقية لصالح التوسع الربحي والعسكري، تؤكد التقارير أن شركات كبرى مثل مايكروسوفت وغوغل وأمازون وغيرها تتسابق للحصول على عقود دفاعية تشمل تحليل الاستخبارات وتوجيه العمليات العسكرية. وهكذا يتجلى تناقض حاد: تحذيرات من "مخاطر وجودية مستقبلية" مقابل مشاركة فعلية في أنظمة تؤثر في حياة وموت البشر اليوم.

ولفتت ليبراسيون إلى أننا نعيش مفارقة 2026: القدرة على إنجاز المهام بسرعة لم تعنِ أبدا العمل أقل، بل تعني إنتاج المزيد في وقت أقصر لصالح أباطرة وادي السيليكون، بينما يظل الإنسان هو الطرف الذي يدفع الثمن من صحته النفسية، وهويته، وأمنه.

وبينما تتسارع هذه المنظومة بلا توقف، يبقى السؤال المركزي مفتوحا: هل يخدم هذا التطور الإنسان فعلا، أم يعيد تشكيله ليتناسب مع سرعة لا يملك القدرة على مجاراتها؟

المصدر:

الجزيرة

المصدر:

الجزيرة