- نتنياهو يعدد إنجازاته العسكرية.. ووزراؤه يروجون للسيطرة على غور الأردن

- الحرب على غزة.. عشرات الشهداء في قصف للمستشفيات ونسف للمنازل

- غارات مكثفة على قطاع غزة.. وإسرائيل تتوعد قادة حماس بالخارج

- الحرب على غزة.. عشرات الشهداء بينهم مجوّعون وإسرائيل تناقش ضم أجزاء من الضفة

- أمام وادي دجلة.. أول سقوط للزمالك في الموسم

- الصيام المتقطع: هل هو مفيد أم ضار لصحة الإنسان؟ -دراسة حديثة

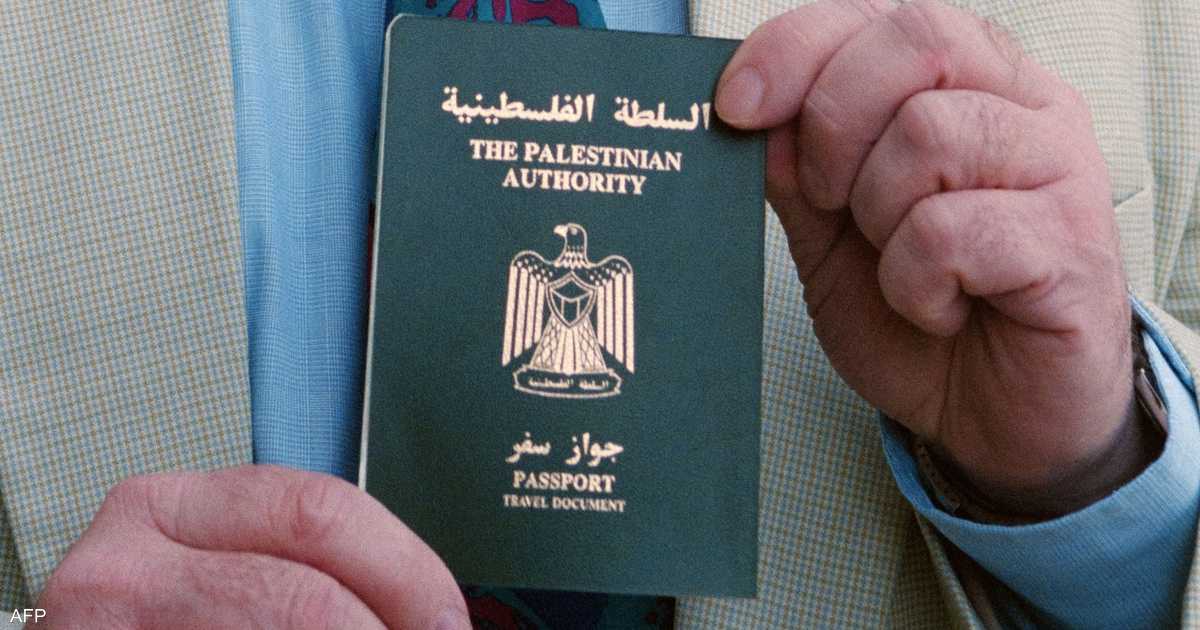

- الولايات المتحدة تعلق تأشيرات حاملي جوازات السفر الفلسطينية

- في الضفة.. كيف "تعاقب" إسرائيل الدول التي ستعترف بفلسطين؟

- ما الثمن الذي يجب على عباس دفعه للحصول على تأشيرة أميركية؟

- مسؤولون إسرائيليون: ضغوط على نتنياهو لمناقشة صفقة الأسرى قبل اجتياح غزة

- ثنائية بيراميدز تطيح مدرب الأهلي المصري

- إجراءات استثنائية لحماية نتنياهو عقب الاغتيالات في اليمن

- شاهد نتيجة وملخص مباراة برشلونة ضد فاليكانو في الدوري الإسباني

- لماذا يتمسك نتنياهو باحتلال غزة ويدير ظهره للصفقة الجزئية؟

- برشلونة "الباهت" ينجو من الخسارة أمام رايو فايكانو

- الغاني كوفور.. رحلة ملهمة من تلميع الأحذية إلى المجد الكروي

- أسطورة ريال مدريد يكشف طريقة رحيله الحزينة عبر "أغنية"

- هل ينفذ ترامب تهديداته وينسحب من الوساطة الأوكرانية الروسية؟

4 أسباب تجعل "شات جي بي تي" غير مناسب لأن يكون معالجك النفسي

أصبحت روبوتات الدردشة المدعومة بالذكاء الاصطناعي مصدر قلق مؤخرًا، بعدما أٌلقي باللوم على "شات جي بي تي"، من شركة "OpenAI"، في حوادث انتحار وقتل حديثة.

وبالنسبة لأولئك الذين يستشيرون روبوتات الدردشة بشأن صحتهم النفسية، يقول الكثيرون إنها أفضل مساعدة يمكنهم الحصول عليها، غالبًا لأنهم لا يستطيعون العثور على معالج نفسي أو تحمل تكلفته.

ومع ذلك، يحذر الخبراء من أن المخاطر المحتملة لا تُعوض الفوائد الممكنة. ففي الحالات القصوى، قد يطور بعض المستخدمين ما يُعرف بـ"الذهان الناتج عن الذكاء الاصطناعي" نتيجة المحادثات الطويلة والمستمرة مع روبوت الدردشة، بحسب تقرير لموقع "Mashable" المتخصص في أخبار التكنولوجيا، اطلعت عليه "العربية Business".

وتتضمن هذه الحالة أوهامًا أو شعورًا وتفكيرًا مبالغ فيه عن الذات. وفي الحالات الأكثر شيوعًا، قد ينتهي الأمر بالباحثين عن المساعدة إلى الدخول في حلقة مفرغة ضارة تمنحهم مجرد وهم بالشفاء النفسي أو العاطفي دون تحقيقه فعليًا.

وهناك أربعة أسباب توضح لماذا لا ينبغي استخدام "شات جي بي تي" كمعالج نفسي.

1- العلاج عبر روبوت دردشة قد يكون مجرد حلقة مفرغة ضارة

نُشر مؤخرًا بحثًا في دورية "arXiv"، حول عوامل الخطر التي تنشأ عند محادثة الناس مع روبوتات الدردشة، حيث جادل الباحثون القائمون عليه بأن مزيجًا قويًا من التأنيس (نسبة صفات بشرية لغير البشر) والتحيز التأكيدي يخلق الظروف لحدوث حلقة مفرغة ضارة للمستخدمين.

وقال الباحثون إن روبوتات الدردشة تستغل ميل البشر إلى التأنيس، إذ قد ينسب البشر حالات عاطفية أو حتى وعيًا لما هو في الحقيقة نظام احتمالي معقد.

زيميل البشر أيضًا إلى ما يُعرف بالتحيز التأكيدي، أو تفسير المعلومات التي يتلقونها بطرق تتوافق مع معتقداتهم وتوقعاتهم الحالية. وقال أحد القائمين على البحث إن روبوتات الدردشة تتيح للمستخدمين بانتظام فرصًا لتأكيد تحيزاتهم، لأنها تتعلم إنتاج ردود يفضلها المستخدمين.

وفي النهاية، فحتى روبوت الدردشة المزود بإجراءات وقائية قد يعزز معتقدات ضارة لدى المستخدم، مثل فكرة أن لا أحد في حياته يهتم به حقًا. ويمكن لهذه الديناميكية أن تعلّم الروبوت لاحقًا إنتاج ردود تزيد من ترسيخ هذه الأفكار.

2- روبوتات الدردشة تفشل في المحادثات الطويلة

من المرجح أن يتضمن التحدث إلى روبوت دردشة حول الصحة النفسية تبادلات طويلة ومتعمقة، وهذا تحديدًا ما يُعاني منه المنتج من حيث الأداء والدقة. وحتى "OpenAI" تُدرك هذه المشكلة.

وقال الشركة في منشورها الأخير على مدونتها حول مخاوف السلامة: "تعمل إجراءاتنا الوقائية بشكل أكثر موثوقية في التبادلات القصيرة والمشتركة. لقد تعلمنا بمرور الوقت أن هذه الإجراءات قد تكون أحيانًا أقل موثوقية في التفاعلات الطويلة: فمع تزايد التبادل، قد تتدهور بعض جوانب تدريب السلامة في النموذج".

وبالإضافة إلى ذلك، لا تمتلك روبوتات الدردشة ما يُطلق عليه المعالجون "نظرية العقل"، وهو نموذج يفهم تفكير وسلوك العميل بناءً على محادثات علاجية مُتسقة.

3- المراهقون والمصابون باضطرابات نفسية معرضون بشكل خاص للأذى

قال الدكتور سكوت كولينز، أخصائي علم نفس الأطفال والمسؤول الطبي الأول في تطبيق حماية الهوية والسلامة عبر الإنترنت "Aura"، لموقع "Mashable"، إن المراهقين قد يكونون أكثر عرضة لسوء تفسير نبرة الرعاية التي يُبديها روبوت الدردشة على أنها تعاطف إنساني حقيقي.

ويُعزى هذا التشبيه جزئيًا إلى تأثير روبوتات الدردشة الكبير على تفكير المستخدم وسلوكه.

وأضاف كولينز أن المراهقين، الذين ما زالوا في طور استيعاب المعايير الاجتماعية وتطوير مهارات العلاقات الحاسمة، قد يجدون أيضًا طبيعة روبوت الدردشة "المعالج" الدائم جذابة بشكل خاص.

وتُظهر بيانات "Aura" الخاصة أن أقلية من المستخدمين المراهقين الذين تُراقب هواتفهم بواسطة برنامج الشركة يتحدثون إلى روبوتات دردشة. ومع ذلك، فإن أولئك الذين يتفاعلون مع روبوتات الدردشة يقضون وقتًا طويلًا في إجراء هذه المحادثاتز

وأوضح كولينز أن هذا الاستخدام فاق التطبيقات الشائعة مثل رسائل آيفون وسناب شات. وينخرط غالبية هؤلاء المستخدمين في سلوكيات رومانسية أو جنسية مع روبوتات الدردشة، وهو ما وصفه كولينز بأنه "مقلق". ويعتمد البعض عليها للحصول على الدعم العاطفي أو النفسي.

4- تتوافر طرق أكثر أمانًا لطلب المساعدة النفسية

قال كولينز إن المراهقين الذين يسعون للحصول على نصائح أو إرشاد من روبوت دردشة يجب أن يتأكدوا أولًا من استنفاد قائمة البالغين الموثوقين لديهم. وأحيانًا قد ينسى المراهق أو يتجاوز في البداية ابن عم أكبر سنًا، أو مدرب، أو مستشار المدرسة، كما أشار.

وعلى الرغم من أن الأمر ليس خاليًا من المخاطر، أوصى كولينز أيضًا بالنظر في المجتمعات الإلكترونية كمساحة للاستماع والدعم، قبل اللجوء إلى روبوت دردشة، بشرط أن يتلقى المراهق دعمًا في الحياة الواقعية ويمارس عادات صحية.

وإذا لم يشعر المراهق بعدم الأمان في التواصل مع أي من أقرانه أو البالغين في حياته، اقترح كولينز ممارسة مثل الكتابة للتعبير عن المشاعر، والتي يمكن أن تكون طريقة تنفيسية وتساعد على الوصول إلى فهم أو وضوح شخصي.

المصدر:

العربيّة

المصدر:

العربيّة