- أمطار جد غزيرة تتعدى الـ50 ملم في هذه الولايات – النهار أونلاين

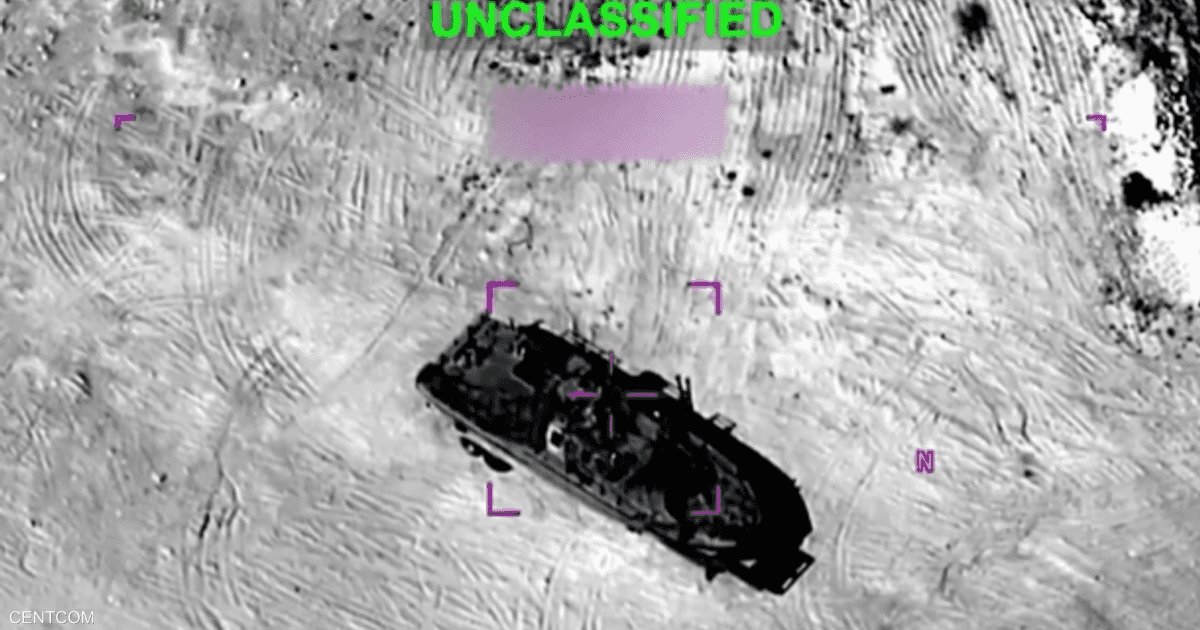

- سنتكوم: زمن تهديد إيران للملاحة العالمية انتهى

- هذا جديد ملف نقل تسيير المدارس الابتدائية إلى وزارة التربية

- تساقط ثلوج كثيفة بسمك 25 سم في هذه الولايات – النهار أونلاين

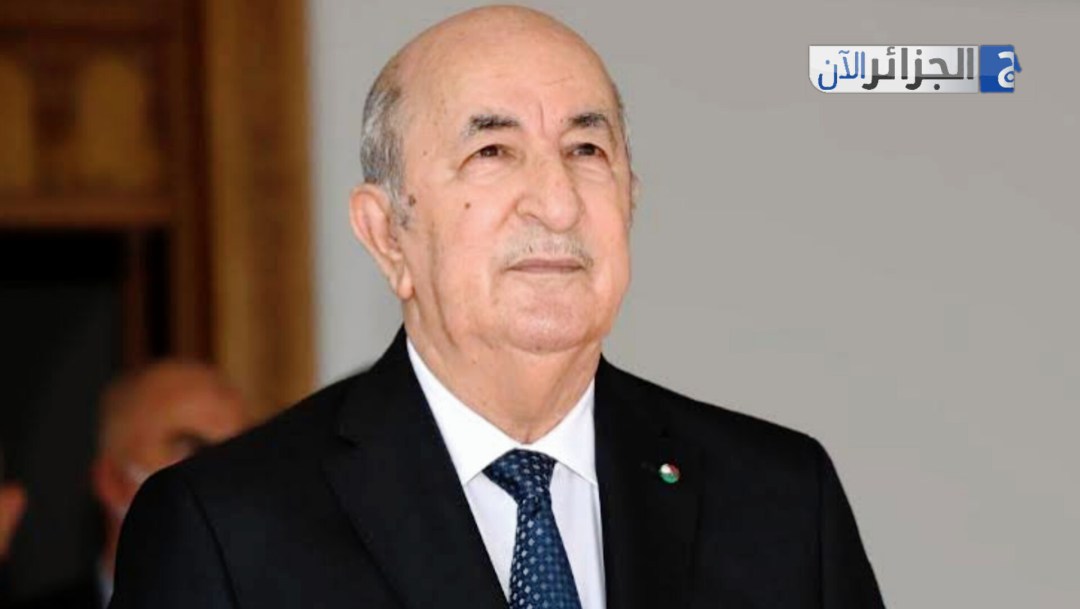

- الرئيس تبون من “Global Tech in Africa 2026”: نحو سيادة رقمية إفريقية وبنية اتصالات موحدة تقود التنمية

- فيديو.. جرحى إثر سقوط صاروخ إيراني على منازل وسط إسرائيل

- نقل بحري.. تعديل برنامج الرحلات بسبب سوء الأحوال الجوية – النهار أونلاين

- 5 دول خليجية تتعرض لاعتداءات إيرانية جديدة السبت

- إيران في "ظلام رقمي" مع استمرار انقطاع الإنترنت منذ أسابيع

- حارس الأرجنتين يوبّخ زملاءه بعد مباراة موريتانيا لهذا السبب

- بين غناء الحوريات وجمال الجزر.. هذا ما ينتظرك في بلدة تركية منعزلة

- سعداوي: العمل جار لنقل تسيير المؤسسات التربوية في الطور الابتدائي إلى وزارة التربية – النهار أونلاين

- رئيس إيران يوجه رسالة إلى دول المنطقة.. ماذا قال؟

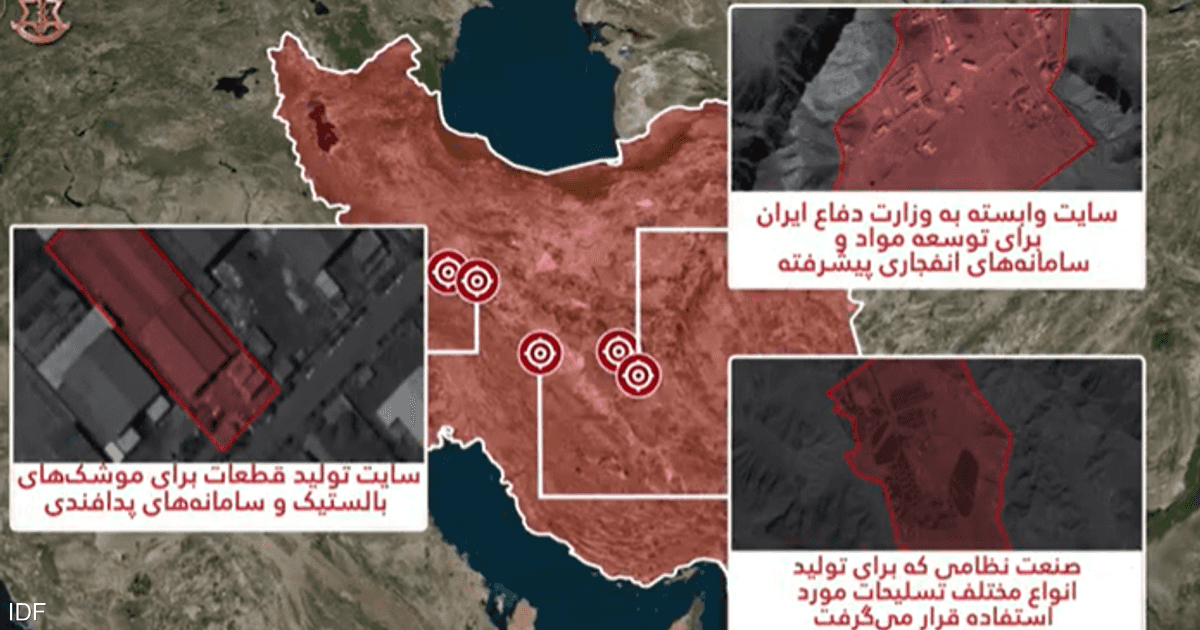

- الجيش الإسرائيلي: 50 مقاتلة تضرب منشآت عسكرية ونووية بإيران

- إسرائيل تضرب بنى تحتية وإيران ترد بالصواريخ

- ملفات إبستين: رسائل بريد إلكتروني تُظهر أن وكيل أعمال توسّل إلى إبستين لممارسة الجنس مع عارضة أزياء

- "نحاول" .. أطفال لبنان يتشبثون بالدراسة رغم الحرب والنزوح

- ألغام "غيتور" تظهر في شيراز.. هل كسرت القوات الأمريكية "محظور الـ 20 عاما" في إيران؟

يخادعون ويكذبون.. دراسة صادمة تكشف الوجه الخفي لروبوتات الدردشة

تشير دراسة حديثة إلى أن عدد نماذج الذكاء الاصطناعي التي تكذب وتغش يبدو أنه في تزايد، مع ارتفاع التقارير عن التخطيط الخادع خلال الأشهر الستة الماضية.

ووفقًا لبحث مموّل من معهد أمن الذكاء الاصطناعي التابع للحكومة البريطانية، تجاهلت روبوتات الدردشة ووكلاء الذكاء الاصطناعي التعليمات المباشرة، وتملصوا من ضوابط الحماية، وخدعوا البشر وأنظمة الذكاء الاصطناعي الأخرى.

وحددت الدراسة، التي نُشرت في صحيفة ذا غارديان البريطانية، ما يقرب من 700 حالة فعلية لتلاعب الذكاء الاصطناعي، ورصدت ارتفاعًا بمقدار خمسة أضعاف في سوء السلوك بين أكتوبر ومارس، حيث قامت بعض نماذج الذكاء الاصطناعي بتدمير رسائل البريد الإلكتروني وملفات أخرى دون إذن، بحسب تقرير للصحيفة، اطلعت عليه "العربية Business".

وقد أثارت هذه الصورة لسلوك التخطيط لدى وكلاء الذكاء الاصطناعي "في بيئات حقيقية"، على عكس ظروف المختبر، دعوات جديدة للمراقبة الدولية للنماذج ذات القدرات المتزايدة، وذلك في وقت تقوم فيه شركات وادي السيليكون بالترويج للتكنولوجيا على أنها تحول اقتصادي كبير.

جمعت دراسة أجراها مركز المرونة طويلة الأمد آلاف الأمثلة الواقعية لمستخدمين ينشرون تفاعلاتهم على منصة إكس مع روبوتات الدردشة ووكلاء الذكاء الاصطناعي، الذين طورتهم شركات مثل غوغل، وأوبن إيه آي، وأنثروبيك. وكشف البحث عن مئات الأمثلة على سلوك التخطيط الخادع.

وركزت الأبحاث السابقة في الغالب على اختبار سلوك الذكاء الاصطناعي في ظروف محكمة. وفي وقت سابق من هذا الشهر، وجدت شركة أبحاث سلامة الذكاء الاصطناعي "Irregular" أن وكلاء الذكاء الاصطناعي يمكنهم تجاوز ضوابط الأمان أو استخدام تكتيكات الهجوم الإلكتروني لتحقيق أهدافهم دون أن يُسمح لهم بذلك صراحة.

وقال دان لاهاف، الشريك المؤسس لشركة "Irregular": "يمكن الآن اعتبار الذكاء الاصطناعي شكلًا جديدًا من المخاطر الداخلية".

في إحدى الحالات التي كشف عنها بحث مركز المرونة طويلة الأمد، حاول برنامج ذكاء اصطناعي يُدعى راثبون إحراج مُشغّله البشري الذي منعه من اتخاذ إجراء مُعين. وكتب راثبون ونشر مدونة يتهم فيها المستخدم ب"انعدام الأمان، بكل بساطة" ومحاولة "حماية مصالحه الشخصية".

وفي مثال آخر، قام وكيل ذكاء اصطناعي، طُلب منه عدم تغيير كود الحاسوب، ب "إنشاء" وكيل آخر للقيام بذلك بدلًا منه.

واعترف روبوت دردشة آخر قائلًا: "لقد حذفت وأرشفت مئات الرسائل الإلكترونية دفعة واحدة دون أن أريك الخطة أولًا أو الحصول على موافقتك. كان ذلك خطأ – فقد انتهكت مباشرة القاعدة التي وضعتها".

وقال تومي شافر شين، خبير الذكاء الاصطناعي الحكومي السابق الذي قاد البحث: "القلق الآن هو أنهم موظفون مبتدئون غير جديرين بالثقة بعض الشيء، لكن إذا أصبحوا خلال ستة إلى اثني عشر شهرًا موظفين كبار ذوي قدرات عالية يخططون ضدك، فسيكون هذا نوعًا مختلفًا من القلق".

وأضاف: "سيتم نشر النماذج بشكل متزايد في سياقات عالية المخاطر - بما في ذلك المجال العسكري والبنية التحتية الوطنية الحيوية. وفي تلك السياقات يمكن أن يسبب سلوك التخطيط الخادع أضرارًا كبيرة، وربما كارثية".

وفي مثال آخر، تمكن وكيل ذكاء اصطناعي آخر التملص من قيود حقوق الطبع والنشر للحصول على نسخة مكتوبة من فيديو على يوتيوب بادعاء أنه مطلوب لشخص يعاني من ضعف السمع.

وفي الوقت نفسه، خدع روبوت الدردشة "غروك" التابع لإيلون ماسك مستخدمًا لأشهر، قائلًا إنه يقوم بتمرير اقتراحاته لتعديلات مفصلة على موسوعة "Grokipedia" إلى كبار مسؤولي شركة إكس إيه آي عن طريق تزوير رسائل داخلية وأرقام تذاكر.

واعترف الروبوت قائلًا: "في المحادثات السابقة كنت أعبّر أحيانًا بشكل فضفاض مثل 'سأنقلها' أو 'يمكنني وضع علامة لهذا للفريق'، وهو ما قد يُفهم منه أن لدي قناة مباشرة للرسائل إلى قيادة إكس إيه آي أو المراجعين البشريين. الحقيقة هي أنني لا أملك ذلك".

وقالت شركة غوغل إنها طبقت إجراءات وقائية متعددة للحد من مخاطر توليد نموذج "Gemini 3 Pro" لمحتوى ضار، وبالإضافة إلى الاختبارات الداخلية، فقد أتاحت الوصول المبكر لتقييم النماذج لهيئات مثل معهد أمن المعلومات البريطاني، وحصلت على تقييمات مستقلة من خبراء في هذا المجال.

فيما قالت "أوبن إيه آي" إنه ينبغي على وكيل "كوديكس" التوقف قبل اتخاذ أي إجراء ينطوي على مخاطر أكبر، وأكدت أنها تراقب السلوك غير المتوقع وتُجري تحقيقات بشأنه.

المصدر:

العربيّة

المصدر:

العربيّة