- حرب إيران.. أنباء عن تحديد ترمب زمنا نهائيا للمفاوضات وطهران على “أهبة الاستعداد”

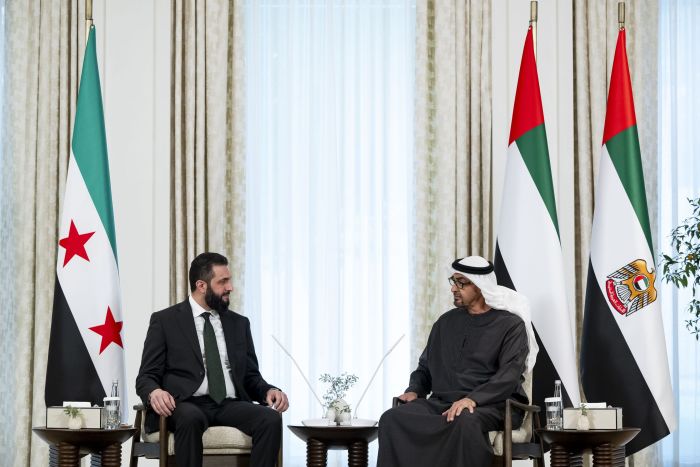

- الشرع يعلق على مباحثاته مع محمد بن زايد خلال زيارته الإمارات

- إحداهما ما زالت عالقة.. إصابة صحفيتين لبنانيتين خلال غارات إسرائيلية

- خلال عملية "الغضب الملحمي".. كشف حصيلة الجرحى الأميركيين

- من سيواجه النصر في نهائي دوري أبطال آسيا 2؟

- نفط على الورق.. كيف تفاعل خبراء الاقتصاد مع تغريدة قاليباب عن أسواق الطاقة؟

- إيران: الحصار الأميركي ينتهك وقف إطلاق النار

- البيت الأبيض: أميركا تريد ردا إيرانيا موحدا على مقترحاتها

- البنتاغون يكشف مدة تطهير مضيق هرمز من الألغام

- كبير مفاوضي إيران: إعادة فتح مضيق هرمز مستحيلة بسبب الحصار الأمريكي

- عقوبات تطال الشباب السعودي وزاخو العراقي بعد مشاجرة لاعبين

- جولة تفاوض جديدة بين لبنان وإسرائيل.. إلى ماذا يسعى الطرفان؟

- تفاصيل هجمات مليشيات مسلحة وعمليات اختطاف بغزة

- "تجنيد 2024".. مشاهد معارك مقاتل قسامي في غزة تخطف الأنظار

- حرب إيران تعزز هيمنة أحواض السفن الصينية

- شبح الاضطرابات الاجتماعية يخيم على روسيا

- فنان أمريكي مصري يثير غضب أنصار ترمب بكلمات عربية في برنامج "شارع سمسم"

- ترامب يعلن خبرا سارا بشأن "نساء المشنقة" في إيران

دراسة: المستخدمون مستاؤون من روبوتات الدردشة لهذا السبب

كشفت دراسة حديثة أن محاولات روبوتات الدردشة لإظهار التعاطف مع المستخدمين قد تأتي بنتائج عكسية، خاصة في حالات فشل الخدمة، حيث يشعر العملاء بعدم الارتياح بدلاً من التهدئة.

وبحسب ما أورده موقع "Techxplore"، فقد توصلت دراسة منشورة في مجلة "MIS Quarterly" إلى أن عبارات مثل “أتفهم إحباطك” عندما تصدر عن روبوتات الدردشة مثل تشات جي بي تي قد تؤدي إلى نتائج سلبية.

وأجرى باحثون من جامعة ماكجيل وجامعة جنوب فلوريدا وجامعة هونغ كونغ المعمدانية، ثلاث تجارب مختلفة، تفاعل خلالها المشاركون مع روبوتات دردشة ارتكبت أخطاء في تقديم الخدمة.

وفي بعض الحالات، استخدمت الروبوتات عبارات تعاطفية بعد الخطأ، بينما اكتفت في حالات أخرى بالرد المباشر دون الإشارة إلى مشاعر المستخدم.

وكانت النتيجة أن التعاطف الاصطناعي لم يحقق الغرض منه، بل أثار ما يُعرف بالرفض النفسي، وهو رد فعل سلبي يحدث عندما يشعر الأفراد بأن حريتهم أو سيطرتهم مهددة.

ويرى الباحثون أن إحساس المستخدم بأن النظام قام بتحليل مشاعره والرد عليها قد يبدو تدخلياً وغير مريح، ما ينعكس سلباً على مستوى الرضا عن الخدمة.

وتشير الدراسة إلى أن نقل أساليب التعاطف البشري إلى الأنظمة الذكية لا ينجح دائماً، ما يستدعي إعادة التفكير في تصميم تفاعلات هذه الأنظمة.

وبدلاً من ذلك، ينصح الباحثون بالاعتماد على أساليب بديلة، مثل الاعتذار المباشر أو استخدام أسلوب بسيط وواضح، وربما إدخال بعض الفكاهة أو العبارات الإيجابية، دون محاولة محاكاة المشاعر الإنسانية بشكل مبالغ فيه.

وتخلص الدراسة إلى أن جعل روبوتات الدردشة تبدو أكثر إنسانية ليس دائماً الخيار الأفضل، إذ قد يكون من الأنسب في بعض الحالات أن تظل هذه الأنظمة في إطارها الوظيفي الواضح بعيداً عن التعاطف المصطنع.

المصدر:

العربيّة

المصدر:

العربيّة